1. Introducción

El diseño de redes seguras es una de las competencias fundamentales para cualquier profesional de la ciberseguridad. Antes de proteger sistemas o detectar ataques, es necesario construir infraestructuras que reduzcan al máximo la superficie de exposición y que incorporen mecanismos de defensa desde su propio diseño.

En este tutorial aprenderemos a diseñar, implementar y analizar arquitecturas de red seguras utilizando GNS3, una herramienta de virtualización de redes ampliamente utilizada tanto en entornos profesionales como académicos.

A lo largo de los diferentes apartados se construirán laboratorios que permitirán experimentar con:

-

Segmentación de red.

-

Firewalls.

-

Control de acceso.

-

Análisis de tráfico.

-

Simulación de ataques.

Todo ello en un entorno controlado donde es posible probar configuraciones, cometer errores y aprender sin riesgo para sistemas reales.

1.1 Objetivos

El objetivo principal de este tutorial es proporcionar los conocimientos necesarios para diseñar y desplegar redes seguras en un entorno de laboratorio virtualizado.

Los objetivos específicos son los siguientes:

-

Comprender los principios básicos del diseño de redes seguras.

-

Aprender a utilizar GNS3 como plataforma de simulación de infraestructuras de red.

-

Diseñar arquitecturas de red que incorporen segmentación y control de accesos.

-

Implementar mecanismos de seguridad como firewalls, DMZ y reglas de filtrado.

-

Analizar el tráfico de red para detectar comportamientos sospechosos.

-

Experimentar con escenarios de ataque y defensa en un entorno controlado.

Al finalizar el tutorial el alumno será capaz de construir laboratorios de ciberseguridad realistas que reproduzcan arquitecturas similares a las utilizadas en entornos empresariales.

1.2 Requisitos

Para poder seguir este tutorial y construir los laboratorios con éxito, es necesario cumplir con los siguientes requisitos:

-

Conocimientos técnicos: Comprensión básica de redes, modelo OSI, enrutamiento estático y dinámico, y subnetting IPv4.

-

Requisitos de hardware: GNS3, al emular sistemas operativos reales, requiere recursos significativos. Se recomienda disponer de un equipo con un mínimo de 8 GB de memoria RAM y un procesador moderno con soporte habilitado en la BIOS para virtualización por hardware (Intel VT-x o AMD-V).

1.3 Diseño de redes seguras

El diseño de redes seguras consiste en planificar y estructurar una infraestructura de red para reducir al máximo los riesgos de seguridad.

Más allá de la simple instalación de dispositivos defensivos, este enfoque implica concebir una arquitectura resiliente desde su origen lo que se conoce como seguridad desde el diseño o Security by Design.

Para lograrlo, esta disciplina se apoya en los siguientes principios fundamentales:

-

Segmentación de red: Consiste en dividir la red en diferentes zonas o subredes aisladas. Esto evita el movimiento lateral, impidiendo que un atacante pueda desplazarse libremente por toda la infraestructura si logra comprometer un equipo.

-

Principio de mínimo privilegio (PoLP): Garantiza que cada sistema, aplicación o usuario disponga únicamente de los permisos de acceso estrictamente necesarios para desempeñar sus funciones legítimas.

-

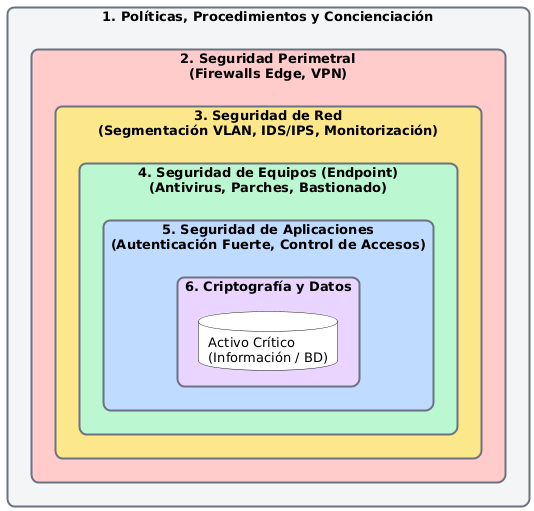

Defensa en profundidad: Parte de la premisa de que la seguridad no debe depender de una única barrera. Implica desplegar múltiples capas de protección superpuestas (como firewalls, sistemas de detección de intrusiones, control de acceso y cifrado), de modo que si una falla, las demás sigan protegiendo el sistema.

-

Reducción de la superficie de ataque: Se basa en limitar al máximo los puntos vulnerables de la red. Cuantos menos servicios, puertos o aplicaciones estén expuestos, menor será la probabilidad de sufrir una brecha de seguridad.

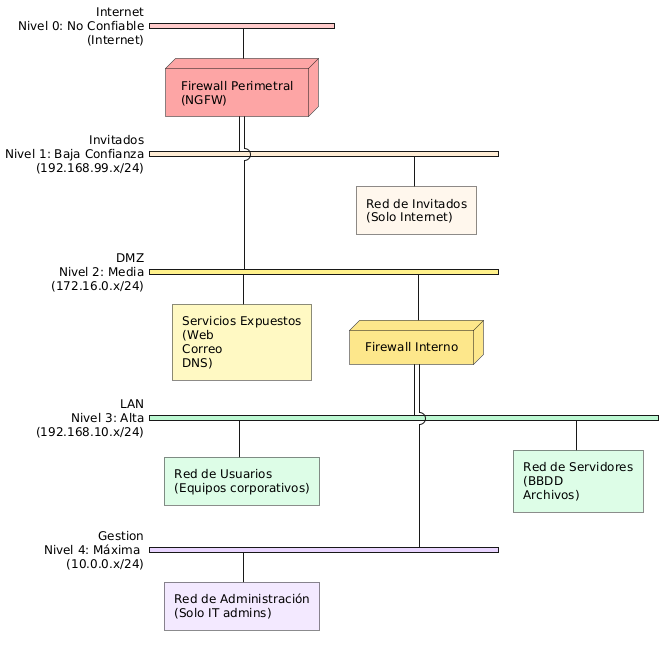

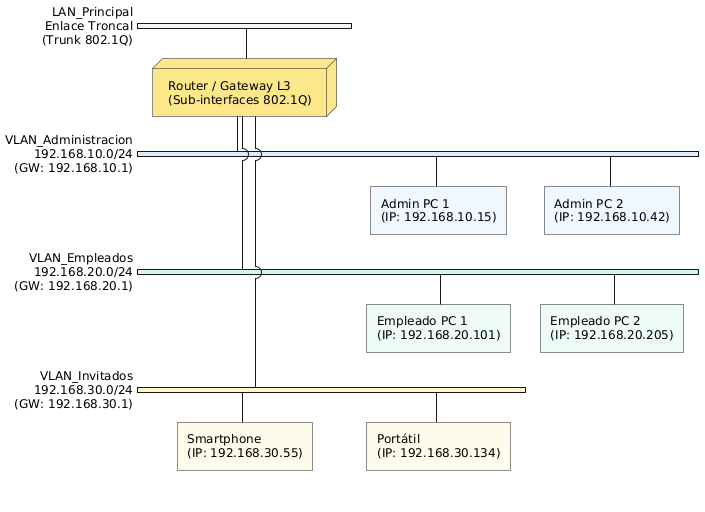

Principales componentes de una red segura

Para materializar estos principios, el diseño de una red segura integra habitualmente los siguientes componentes estructurales y defensivos:

-

Redes internas (LAN) segmentadas para proteger los activos críticos de la organización.

-

Redes perimetrales y Zonas Desmilitarizadas (DMZ), diseñadas para aislar los servicios expuestos al exterior (como servidores web o de correo) del resto de la red interna.

-

Sistemas de filtrado de tráfico, como firewalls de próxima generación (NGFW) o proxies.

-

Sistemas de monitorización continua, que permiten detectar anomalías y responder a incidentes en tiempo real.

![Ejemplo de arquitectura de red. Imagen obtenida de https://brezular.com/2017/09/07/enterprise-network-on-gns3-part-1-introduction/[Brezular]](images/enterprise_network_gns3.png)

1.4 Importancia del laboratorio en ciberseguridad

La ciberseguridad es una disciplina eminentemente práctica. Muchos conceptos solo se comprenden completamente cuando se experimenta con ellos en entornos reales o simulados.

Un laboratorio de ciberseguridad permite probar configuraciones, simular ataques, analizar tráfico y estudiar vulnerabilidades sin comprometer sistemas de producción reales. Además, permite reproducir situaciones peligrosas o complejas, como:

-

Ataques de escaneo de red.

-

Explotación de servicios vulnerables.

-

Ataques de denegación de servicio.

-

Movimientos laterales dentro de una red.

Por ello, en la formación técnica es habitual trabajar con infraestructuras virtualizadas.

1.5 Qué es GNS3

GNS3 (Graphical Network Simulator 3) es una plataforma de emulación y orquestación de redes que permite crear laboratorios complejos utilizando dispositivos virtuales reales.

Emulación vs. simulación

A diferencia de otros programas orientados a la enseñanza básica, es vital entender la diferencia técnica de GNS3:

-

Simulación: Se imita el comportamiento de un dispositivo. Los comandos y respuestas están preprogramados en el software, como ocurre en Packet Tracer.

-

Emulación: El software ejecuta el sistema operativo real del dispositivo de red (como Cisco IOS, pfSense o FortiOS) dentro de un entorno virtual que reproduce el comportamiento del hardware original. De este modo, el sistema operativo funciona igual que lo haría en un equipo físico. Esto permite utilizar todos los comandos, configuraciones y funcionalidades reales del dispositivo, e incluso reproducir comportamientos o errores propios del sistema.

Imágenes

Al actuar como una plataforma de orquestación, GNS3 no incluye por defecto los sistemas operativos de los dispositivos de red.

Por motivos de licencias y derechos de autor, el programa no distribuye las imágenes de routers, firewalls u otros equipos. Por ello, el usuario debe proporcionar e importar las imágenes de los dispositivos que desea emular, ya sea utilizando sistemas libres como distribuciones de Linux o aportando imágenes obtenidas legalmente, como las de routers Cisco.

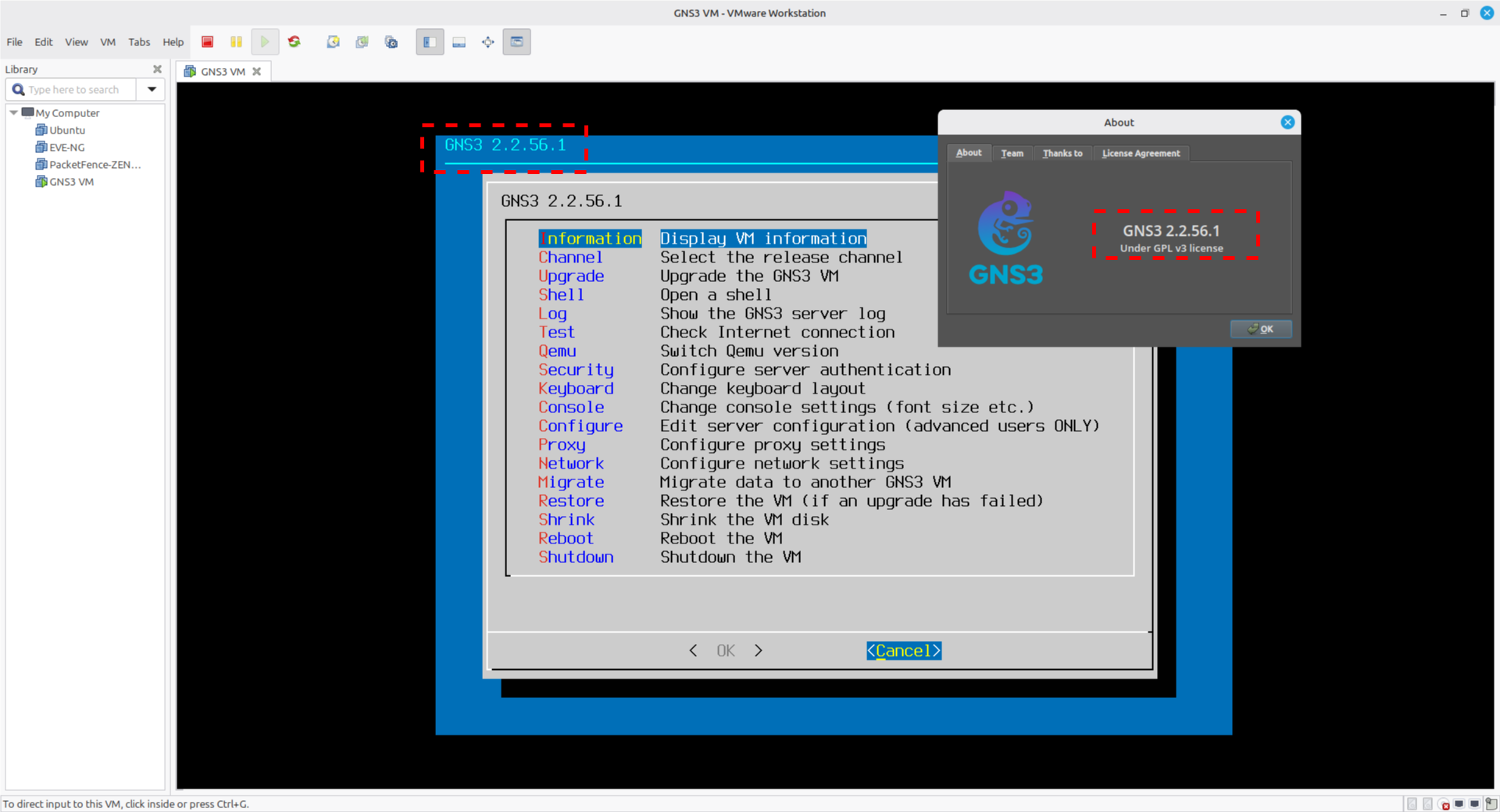

Arquitectura del software

GNS3 se divide en dos componentes principales que trabajan de forma conjunta:

-

Cliente (GUI): Es la interfaz gráfica de escritorio que se instala en el ordenador del usuario. Desde aquí se diseña la topología de red arrastrando dispositivos.

-

Servidor: Es el motor de virtualización que ejecuta los dispositivos y consume los recursos de RAM/CPU. El servidor puede ser:

-

Local: Se ejecuta en el mismo ordenador que el cliente.

-

Una máquina virtual local (GNS3 VM): Es la VM oficial de GNS3 para ejecutar el servidor.

-

Remoto: Se ejecuta en un servidor externo.

-

Aunque GNS3 puede ejecutarse directamente en el sistema local, la práctica recomendada es utilizar la GNS3 VM. De esta forma se obtiene un mejor rendimiento y se evitan posibles conflictos con el sistema operativo anfitrión.

1.6 Comparativa con otras herramientas

Existen varias herramientas que permiten crear laboratorios virtuales. Cada una tiene características y públicos diferentes:

EVE-NG

EVE-NG (Emulated Virtual Environment Next Generation) es una plataforma de emulación de redes de grado profesional muy potente. Su principal diferencia con GNS3 radica en su arquitectura clientless donde todo se gestiona directamente desde un navegador web, sin necesidad de instalar un programa cliente (GUI) en el ordenador.

Packet Tracer

Packet Tracer es una herramienta de simulación desarrollada por Cisco y orientada principalmente a la enseñanza de redes. Es excelente para iniciarse, pero presenta limitaciones importantes ya que sólo simula dispositivos Cisco, no ejecuta sistemas operativos reales y los comandos disponibles están restringidos, lo que limita enormemente las pruebas avanzadas de ciberseguridad.

VirtualBox y VMware

VirtualBox y VMware son hipervisores puros que permiten ejecutar máquinas virtuales completas pero no están diseñados para cablear y orquestar topologías de red complejas de forma visual. Por este motivo, su uso ideal es combinarlos como motores de apoyo para plataformas como GNS3 o EVE-NG.

2. Instalación de GNS3

La correcta instalación de GNS3 es el cimiento sobre el que construiremos todos nuestros laboratorios de ciberseguridad. Dado que GNS3 es una herramienta en constante evolución, en esta sección nos apoyaremos en la documentación oficial para garantizar que sigues los pasos más actualizados.

A continuación, se muestra qué recursos debes consultar y qué aspectos clave debes tener en cuenta en cada paso.

2.1 Introducción a GNS3

Antes de descargar nada, es importante familiarizarse con los requisitos del sistema y la arquitectura del software que vimos en el capítulo anterior. La guía oficial de introducción te dará una visión general de lo que estás a punto de instalar.

Lectura recomendada:

2.2 Instalación del cliente (GUI)

El primer componente que debes instalar es la interfaz gráfica (GNS3-all-in-one). Durante este proceso, el instalador te sugerirá añadir herramientas complementarias como Wireshark (esencial para nuestros laboratorios de análisis de tráfico) o Npcap/WinPCAP. Asegúrate de aceptar estas dependencias.

Elige la guía correspondiente a tu sistema operativo.

Guías oficiales:

2.3 Descarga e importación de la GNS3 VM

Como aprendimos en la introducción, para emular infraestructuras complejas y seguras de forma estable, utilizaremos la GNS3 VM. Esta máquina virtual actuará como el motor de nuestro laboratorio, ejecutando los firewalls y routers pesados.

Guía oficial:

|

Es muy importante descargar la versión de la GNS3 VM que coincida exactamente con la versión del cliente GUI que has instalado. De lo contrario, podrías experimentar problemas de compatibilidad. |

2.4 Configuración inicial y conexión con la GNS3 VM

Una vez que tienes el Cliente (GUI) instalado y la Máquina Virtual (GNS3 VM) importada en tu hipervisor, debes conectarlos para que trabajen juntos.

Al abrir GNS3 por primera vez, saltará un asistente de configuración.

También puedes acceder a este asistente en cualquier momento desde el menú superior del cliente GUI: Help > Setup Wizard.

Guía oficial:

|

Asegúrate de configurar el asistente indicando que deseas ejecutar los laboratorios en la máquina virtual (Run appliances in a virtual machine). Si el proceso es exitoso, verás en el la sección Server Summary del panel lateral derecho de GNS3 que el indicador de la GNS3 VM se pone en color verde. |

2.5 Verificación del entorno con GNS3 Doctor

Una vez finalizada la instalación se recomienda verificar que el entorno se ha configurado correctamente y que no existe ningún problema en el sistema anfitrión.

Para facilitar este proceso, GNS3 incluye una herramienta de diagnóstico integrada llamada GNS3 Doctor.

GNS3 Doctor es una utilidad de comprobación del sistema que realiza un escaneo rápido de los requisitos técnicos, permisos y dependencias necesarias para que GNS3 funcione de manera óptima y sin errores.

Puedes ejecutar esta herramienta en cualquier momento desde el menú superior del cliente GUI: Help > GNS3 Doctor.

Si todas las verificaciones son correctas, verás un mensaje de éxito similar a este:

Starting checks...

Check if processor is 64 bit...

OK

Checking if AVG software is not installed...

OK

Checking for stable GNS3 version...

OK

Check if dynamips has the correct permission...

OK

Checking if experimental features are not enabled...

OK

Checking for amount of free virtual memory...

OK

Check if gns3 is not installed twice...

OK

Checking if the local server is enabled...

OK

Check if the RPF service is running (required to use Ethernet NIOs)...

OK

Check if ubridge has the correct permission...

OK

Checking if vmrun is installed...

OK3. Primeros pasos con GNS3

Con la arquitectura base ya instalada (Cliente y GNS3 VM), ha llegado el momento de empezar a diseñar. En esta sección aprenderás a moverte por la interfaz, a añadir tus primeros dispositivos y, lo más importante para nuestros futuros laboratorios de ciberseguridad, a dar salida a Internet a tu red virtual.

A continuación, se muestran las prácticas iniciales utilizando la documentación oficial como referencia.

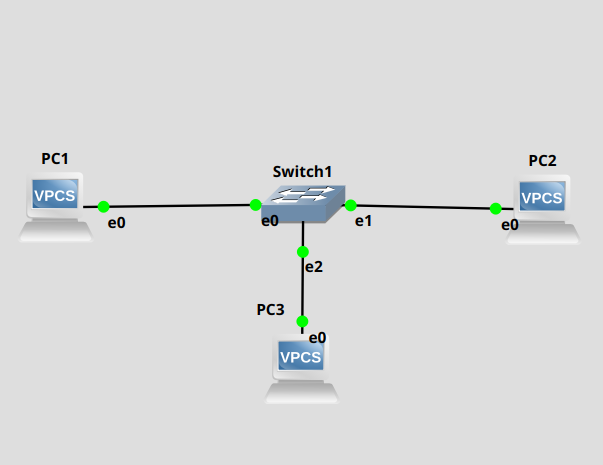

3.1 Práctica: Primera topología básica

Antes de emular sistemas operativos pesados, es recomendable familiarizarse con la interfaz de GNS3. En esta primera práctica aprenderás las mecánicas básicas: arrastrar dispositivos al área de trabajo, conectarlos con cables virtuales, encenderlos y abrir una consola de comandos.

Para ello, utilizaremos los dispositivos integrados más ligeros: un switch básico y un par de VPCs (Virtual PC Simulator), que son ordenadores muy básicos que apenas consumen memoria RAM y permiten realizar pruebas de conectividad con el comando ping.

En este laboratorio tendrás que crear una red de área local (LAN) simple, asignar direcciones IP a dos VPCs y comprobar que hay comunicación entre ellos mediante el comando ping.

Guía oficial:

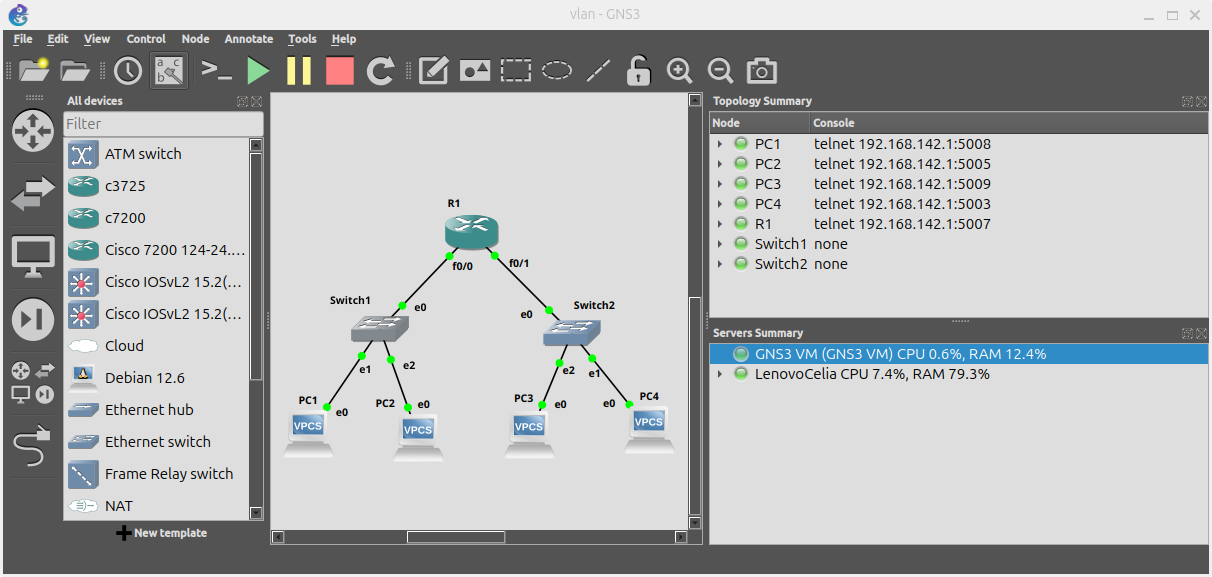

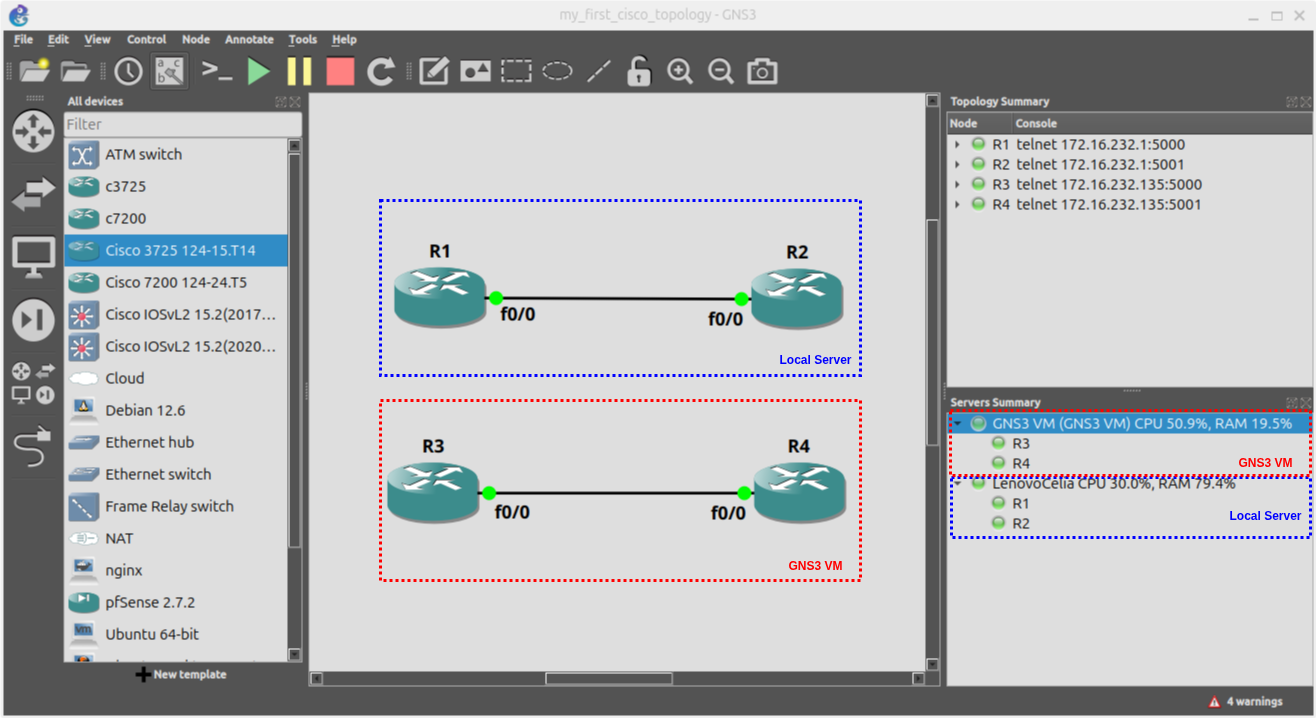

3.2 Práctica: Primera topología con dispositivos Cisco

Aquí es donde GNS3 despliega todo su potencial. Como mencionamos en la introducción, el programa necesita imágenes (appliances) para emular dispositivos reales. En este paso, importaremos el sistema operativo de un router Cisco (Cisco IOS) para poder configurarlo exactamente igual que si tuviéramos el hardware físico frente a nosotros.

|

En este laboratorio se utilizará una imagen de un router Cisco 3725, pero puedes elegir cualquier otro modelo compatible con GNS3. Debido a restricciones de licencia, las imágenes de sistemas operativos de red como Cisco IOS deben obtenerse a través de fuentes oficiales o mediante licencias educativas. |

Guía oficial:

Para importar el router Cisco en GNS3 tendrá que crear una nueva plantilla y el asistente le guiará paso a paso. En un momento del proceso nos preguntará en qué servidor queremos ejecutar esta plantilla:

-

En el servidor local (tu ordenador).

-

En la GNS3 VM (máquina virtual)

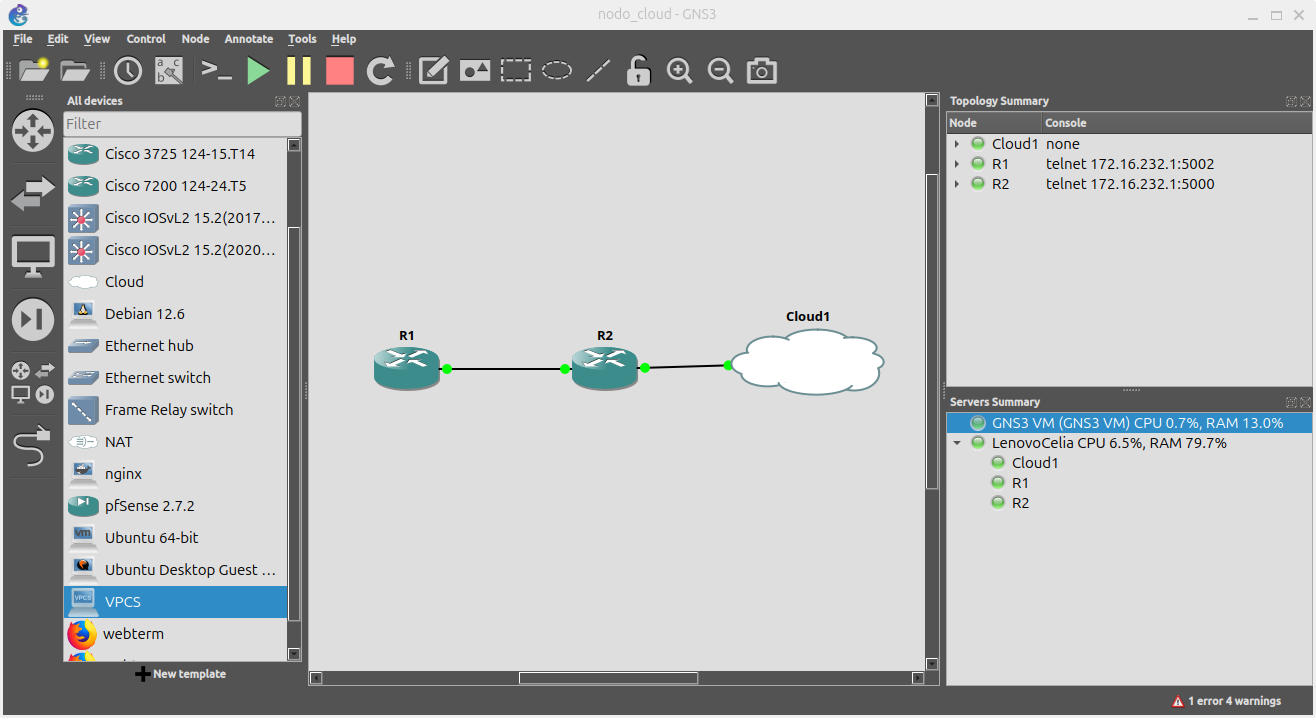

En la siguiente imagen se muestra un ejemplo donde los routers R1 y R2 se están ejecutando en el servidor local, y los routers R3 y R4 se ejecutan en la GNS3 VM.

3.3 Práctica: Conexión a Internet con el nodo Cloud

En los laboratorios de ciberseguridad es habitual necesitar que nuestras máquinas virtuales tengan acceso a Internet para descargar paquetes, actualizarse o simular conexiones externas.

Existen dos formas principales de lograr esto: el nodo Cloud y el nodo NAT.

El nodo Cloud actúa como un puente transparente hacia la tarjeta de red física de tu ordenador. Úsalo si necesitas que los dispositivos de tu laboratorio reciban una IP de tu router doméstico/empresarial real y sean accesibles desde tu red física.

|

Limitaciones con conexiones Wi-Fi Para utilizar el nodo Cloud tendrás que utilizar una conexión física cableada Ethernet. |

Guía oficial:

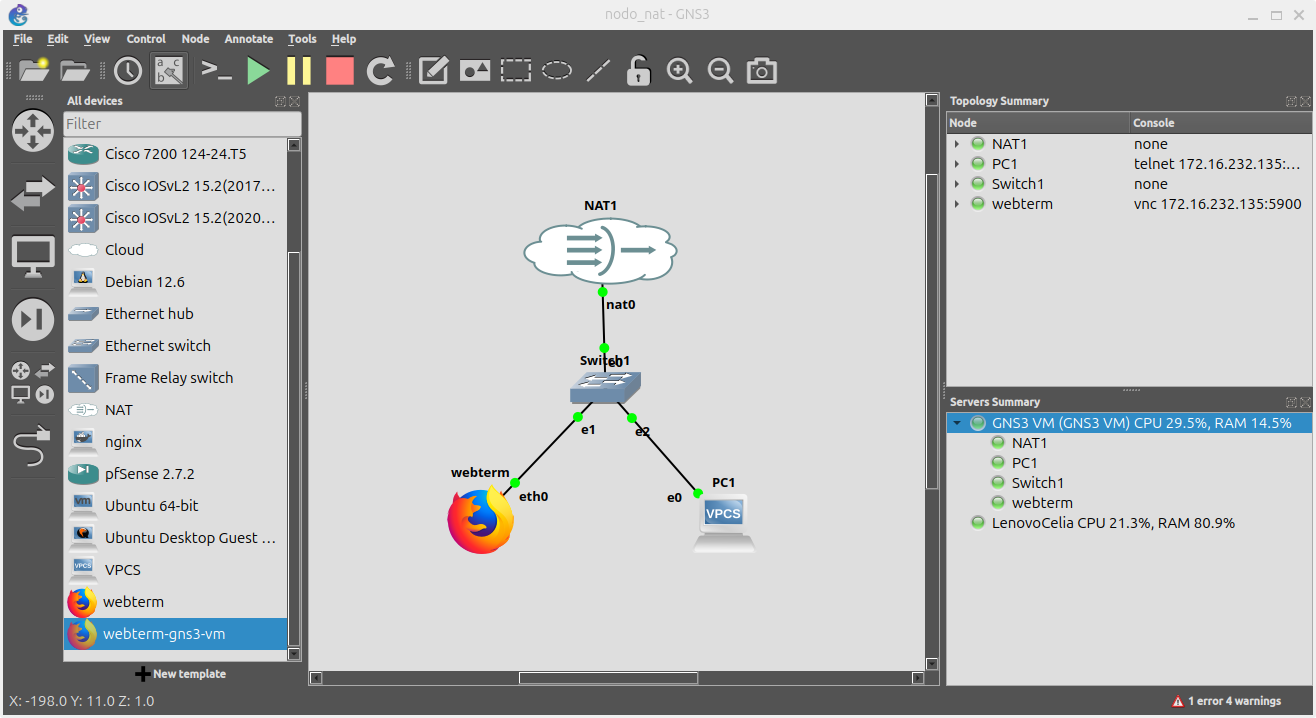

3.4 Práctica: Conexión a Internet con el nodo NAT

Si tu único objetivo es que los equipos virtuales tengan salida a Internet de forma segura y aislada, sin exponerlos a tu red local física, la opción más rápida y recomendada es usar el nodo NAT.

El nodo NAT funciona como un pequeño router virtual que proporciona direcciones IP automáticas mediante DHCP y enmascara el tráfico para que salga a Internet a través de tu PC.

Guía oficial:

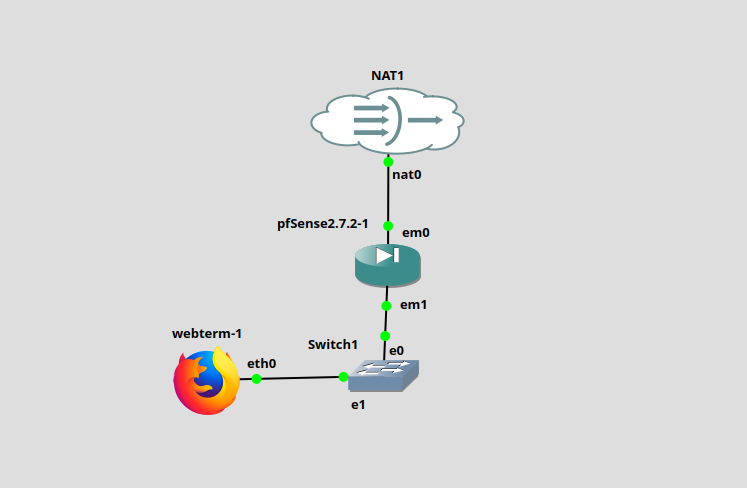

4. Integración de máquinas virtuales externas en GNS3

4.1 Conectar una máquina virtual externa usando la GNS3 VM

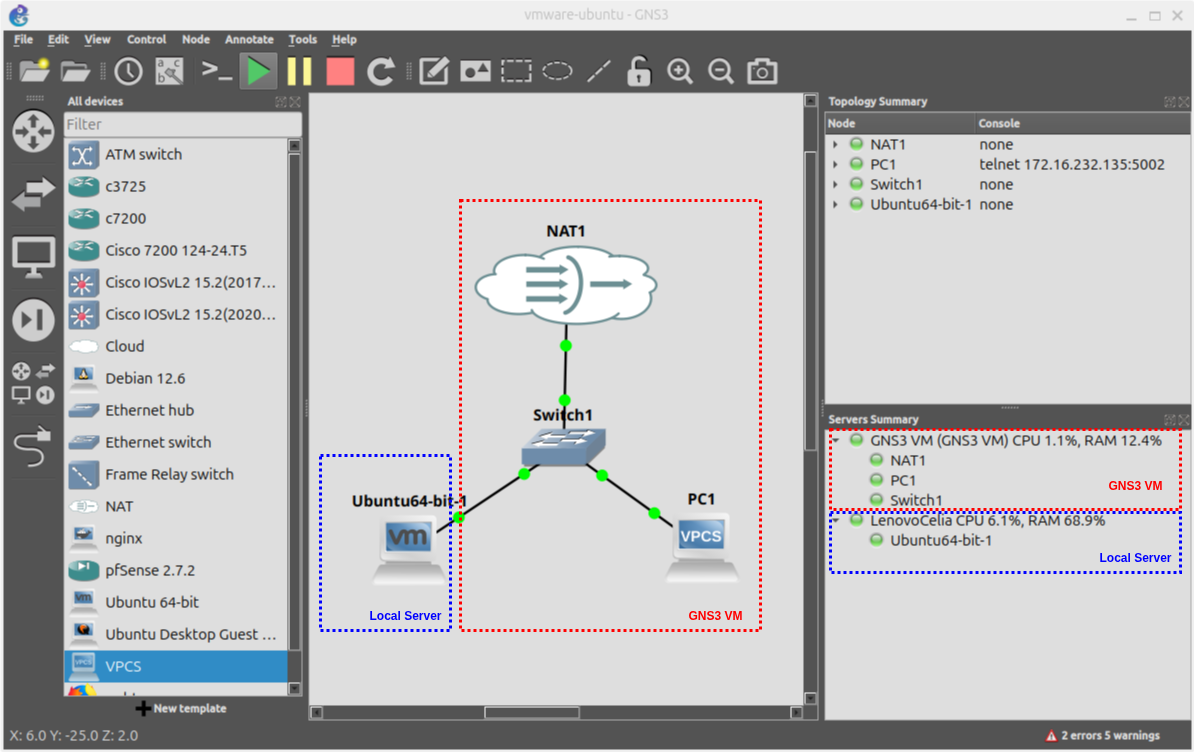

En este laboratorio vamos a interconectar una máquina virtual alojada localmente en tu ordenador en VMware, con una topología de red que se está ejecutando dentro de la máquina virtual de GNS3 (GNS3 VM). Lograremos conectividad total entre un PC virtual (VPC), una máquina virtual Ubuntu en VMWare y daremos salida a Internet a través de un nodo NAT.

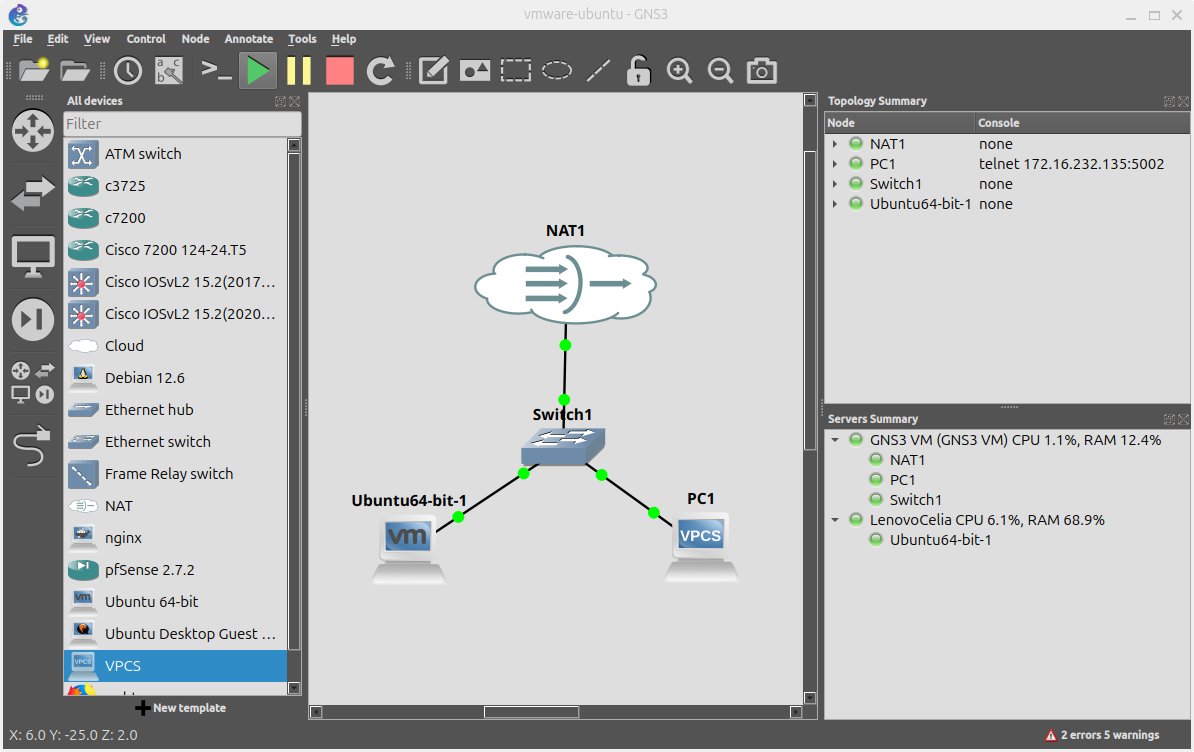

En uno de los paneles de la derecha de la interfaz de GNS3 de la imagen anterior, puede encontrar la sección Server Summary que muestra el estado del servidor local y del servidor GNS3 VM.

En esta sección, se puede verificar que en la máquina virtual de GNS3 VM se están ejecutando los siguientes dispositivos virtuales:

-

Un nodo NAT.

-

Un VPC (Virtual PC Simulator).

-

Un switch genérico de capa 2.

Mientras que en la máquina local se está ejecutando:

-

Una máquina virtual Ubuntu descargada de OSBoxes y ejecutada en VMware.

4.1.1 Descargar una VM preconfigurada de OSBoxes

Para este laboratorio necesitaremos un sistema operativo real que actúe como cliente en nuestra topología. En lugar de instalar un sistema desde cero (descargar la ISO, asignar discos, ejecutar el asistente de instalación…), utilizaremos OSBoxes.

Esta plataforma ofrece discos duros virtuales con sistemas operativos Linux preinstalados y listos para ejecutarse, lo que agilizará enormemente la preparación del laboratorio.

Enlace oficial:

Instrucciones:

-

Selecciona el sistema operativo: Accede al enlace web y busca la distribución Ubuntu que será la recomendada para esta práctica por su facilidad de uso.

-

Elige el hipervisor correcto: Asegúrate de descargar la imagen correspondiente a la pestaña VMware, ya que es el hipervisor que utilizaremos para enlazar la máquina con GNS3.

-

Descarga y descomprime: El archivo se descargará comprimido, generalmente en formato

.7z. Utiliza un programa como 7-Zip para extraer su contenido en una carpeta de tu disco duro. Al hacerlo, obtendrás los archivos listos para abrir directamente desde VMware Workstation o Player.

|

Credenciales por defecto Las máquinas virtuales de OSBoxes vienen con un usuario preconfigurado por defecto. Para poder iniciar sesión en tu Ubuntu utiliza: usuario: contraseña: |

4.1.2 Preparación del entorno host en Linux

Este paso sólo será necesario si tu sistema operativo físico es Linux. Si estás utilizando Windows o macOS, puedes saltar directamente al Paso 2.

GNS3 necesita permisos especiales de red en tu sistema operativo físico para poder crear los “cables virtuales” (túneles uBridge) que conectan VMware con GNS3.

Abre una terminal en tu sistema físico y ejecuta lo siguiente antes de abrir GNS3:

1. Instalación de uBridge:

sudo apt update

sudo apt install ubridge2. Configuración de uBridge:

Después de instalarlo, tiene que otorgar los permisos de ejecución y red para que GNS3 pueda usarlo sin ser root.

sudo groupadd ubridge

sudo usermod -aG ubridge $USER

sudo setcap cap_net_admin,cap_net_raw=ep /usr/local/bin/ubridgePara que se aplique el cambio de grupo, puede cerrar la sesión actual y volver a entrar o ejecutar el siguiente comando para actualizar los grupos sin necesidad de cerrar sesión:

newgrp ubridgeUna vez hecho esto, el programa GNS3 podrá crear las conexiones virtuales necesarias para conectar la máquina virtual de VMware con la GNS3 VM sin necesidad de ejecutar GNS3 como administrador.

|

Ejecute la utilidad de diagnóstico integrada de GNS3, GNS3 Doctor, para verificar que uBridge tiene los permisos correctos. Puedes acceder a esta herramienta desde el menú superior del cliente GUI: Help > GNS3 Doctor. Si todo está bien, verás un mensaje de éxito en la sección diciendo: Check if ubridge has the correct permission. OK. |

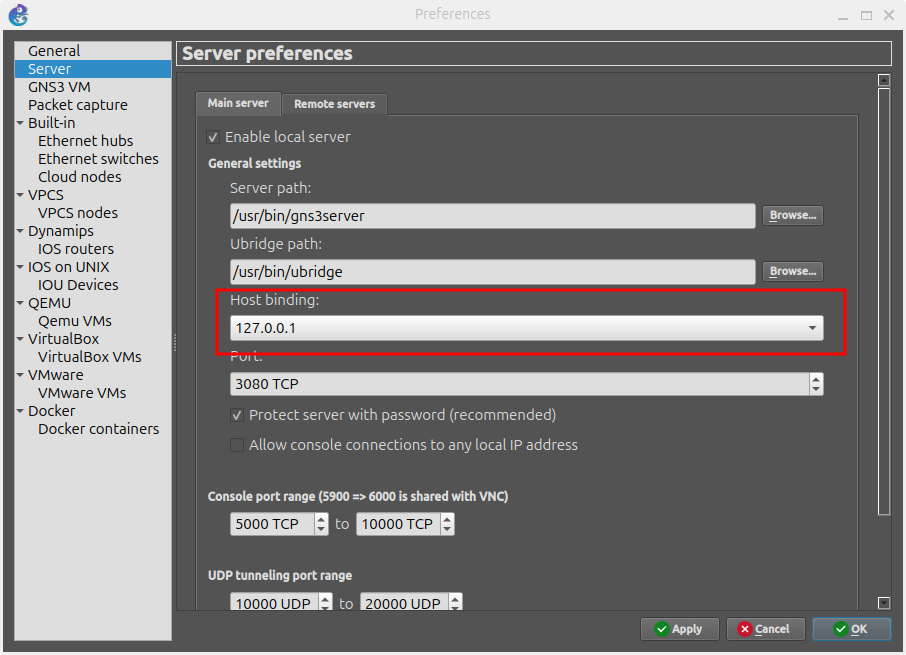

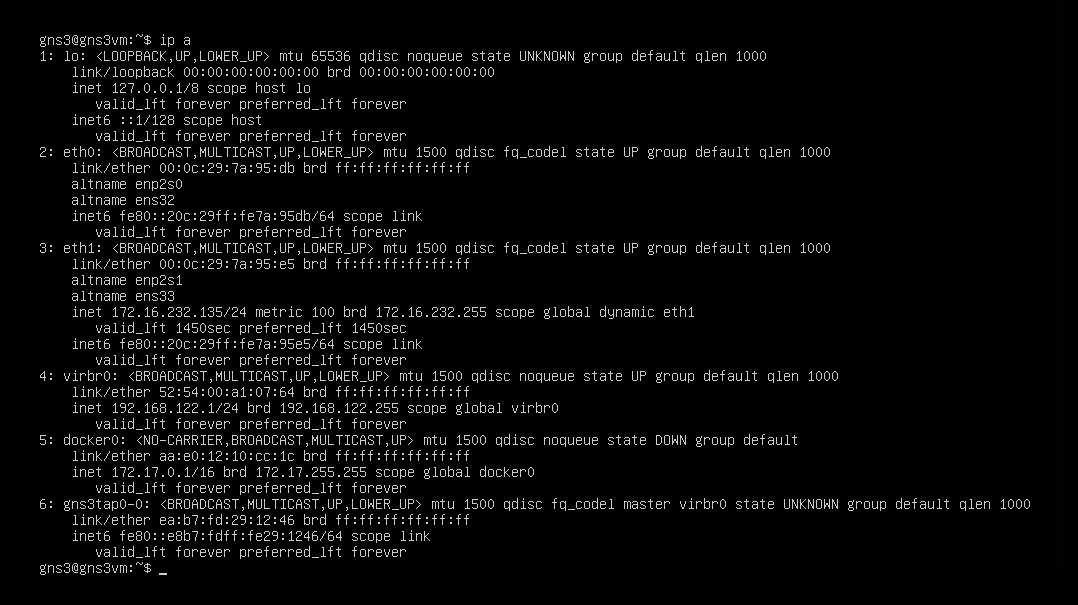

4.1.3 Configuración del servidor en GNS3 (Host Binding)

Este paso es fundamental para que el servidor local de GNS3 y la máquina virtual de VMware puedan verse. Por defecto, GNS3 escucha en la dirección 127.0.0.1 (localhost), una red interna a la que las máquinas virtuales externas no tienen acceso. Debemos cambiar esto.

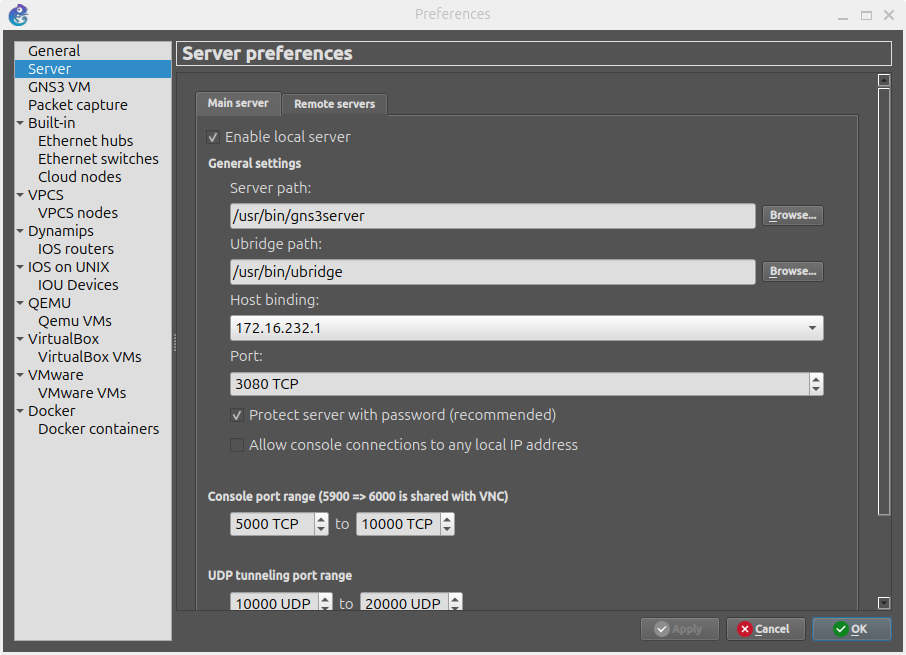

-

Abre GNS3 y ve a Edit > Preferences > Server.

-

En la pestaña Main server, busca el campo Host binding.

-

Aquí tendrás que desplegar la lista y cambiar la dirección

127.0.0.1por la dirección IP de tu ordenador físico que pertenece a la misma red que la GNS3 VM.

Para identificar cuál es la IP correcta, tienes que acceder a la consola de la máquina virtual de GNS3 VM y ejecutar el comando ip a.

En nuestro caso, la IP de la interfaz que conecta nuestro ordenador físico con la GNS3 VM está en la interfaz eth1 y es del tipo 172.16.232.X.

Una vez que has identificado la IP de tu GNS3 VM, selecciona en el campo Host binding la IP de tu ordenador que esté en esa misma red. Por ejemplo, en nuestro caso hemos seleccionado la IP 172.16.232.1.

-

Haz clic en Apply. El servidor local se reiniciará. No cierres la ventana de preferencias todavía.

4.1.4 Integración de VMware en GNS3

Para que GNS3 pueda controlar la máquina de VMware sin errores, debemos configurar cómo gestiona las redes virtuales y la tarjeta de red de la propia máquina.

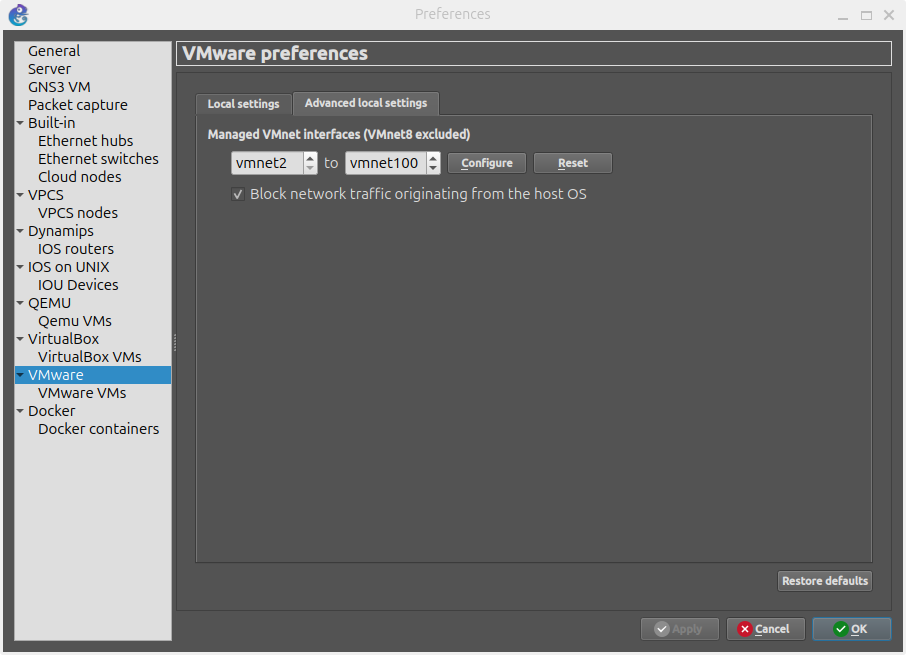

1. Configuración avanzada de VMware:

-

En la misma ventana de Preferencias, selecciona en el menú izquierdo la opción de VMware.

-

Selecciona la pestaña Advanced local settings.

-

Asegúrate de que el rango de Managed VMnet interfaces cubra la red que creaste en el Paso 1. Por ejemplo, de

vmnet2avmnet100. -

Verifica que la casilla “Block network traffic originating from the host OS” esté marcada.

-

Haga clic en el botón Reset para que VMware vuelva a crear las interfaces virtuales de red (

vmnet) dentro del rango que has definido. Le pedirá permisos de administrador para crear estas interfaces, acepta la solicitud. -

Haga clic en el botón Configure para que GNS3 configure automáticamente las interfaces de VMware y les asigne permisos. Le pedirá permisos de administrador, acepta la solicitud.

-

Haz clic en Apply.

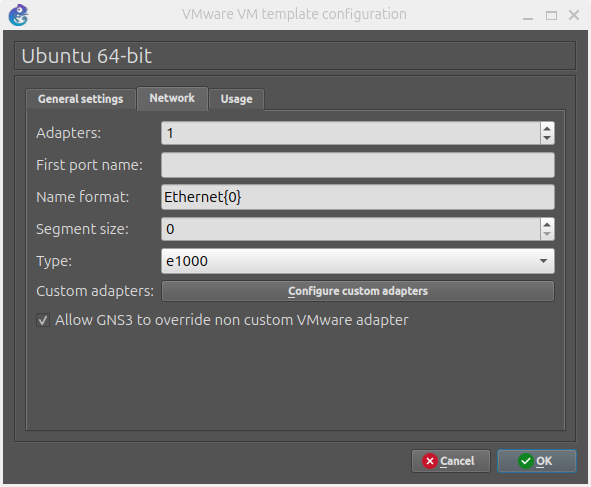

2. Configuración de la plantilla de Ubuntu:

-

En el menú izquierdo de Preferencias, despliega VMware y haz clic en VMware VMs.

-

Si no aparece la máquina virtual que quiere usar, haga click en el botón New y siga los pasos del asistente para importarla. Asegúrate de seleccionar la máquina virtual correcta y asignarle un nombre descriptivo.

-

Una vez importada, selecciónala y haz clic en el botón Edit.

-

Ve a la pestaña Network.

-

Configura que el número de adaptadores sea el mismo que el número de interfaces de red que tiene tu máquina virtual en VMware. Por ejemplo, si tu máquina virtual tiene una sola tarjeta de red, pon 1 en el campo Adapters.

-

En el campo Type dejaremos el valor

e1000, que suele ser el más compatible. -

Asegúrate de que la casilla “Allow GNS3 to override non custom VMware adapter” esté marcada. Esto permite a GNS3 tomar el control del cable virtual.

-

Haz clic en OK en ambas ventanas para guardar todo.

4.1.5 Creación de la topología de red

-

Arrastra un nodo NAT y un Switch Ethernet al área de trabajo. GNS3 te preguntará dónde ejecutarlos, elige GNS3 VM.

-

Arrastra un nodo VPCS (PC1) y ejecútalo también en la GNS3 VM.

-

Arrastra la máquina virtual que has importado y asegúrate de que se ejecuta en tu servidor Local.

-

Conecta todo con cables: Ubuntu al Switch, VPCS al Switch, y Switch al NAT.

|

Si el cable entre Ubuntu y el Switch te da un error, bórralo y vuélvelo a conectar. A veces es necesario para que uBridge actualice la configuración. |

4.1.6 Configuración de IPs

El nodo NAT de GNS3 tiene una medida de seguridad (anti-spoofing) que bloquea IPs estáticas puestas a mano. Todo debe pedir IP por DHCP.

1. Configurar el VPCS:

-

Abre la consola del PC1 y escribe:

ip dhcp -

Toma nota de la IP que le asigna el NAT.

2. Configurar la máquina Ubuntu:

-

Enciende Ubuntu desde GNS3.

-

Ve a la configuración de red (Network settings) en el entorno gráfico.

-

En la pestaña IPv4, selecciona Automatic (DHCP) en lugar de Manual.

-

Apaga y vuelve a encender el interruptor de la conexión de red en Ubuntu.

-

Abre una terminal en Ubuntu y verifica tu IP con

ip a.

4.1.7 Verificación de conectividad

Realiza estas pruebas en orden desde la terminal de tu Ubuntu:

-

Prueba de conectividad de la red local: Ejecuta

ping <IP_DEL_VPCS>. Si funciona, el túnel entre tu PC físico y la GNS3 VM funciona perfectamente. -

Prueba de conectividad con la puerta de enlace: Ejecuta

ping 192.168.122.1. Si funciona, el NAT te ha aceptado en su red. -

Prueba de conectividad a Internet: Ejecuta

ping www.nasa.gov. Si responde, tienes salida completa y resolución DNS.

4.2. Conectar una máquina virtual externa usando el servidor local de GNS3

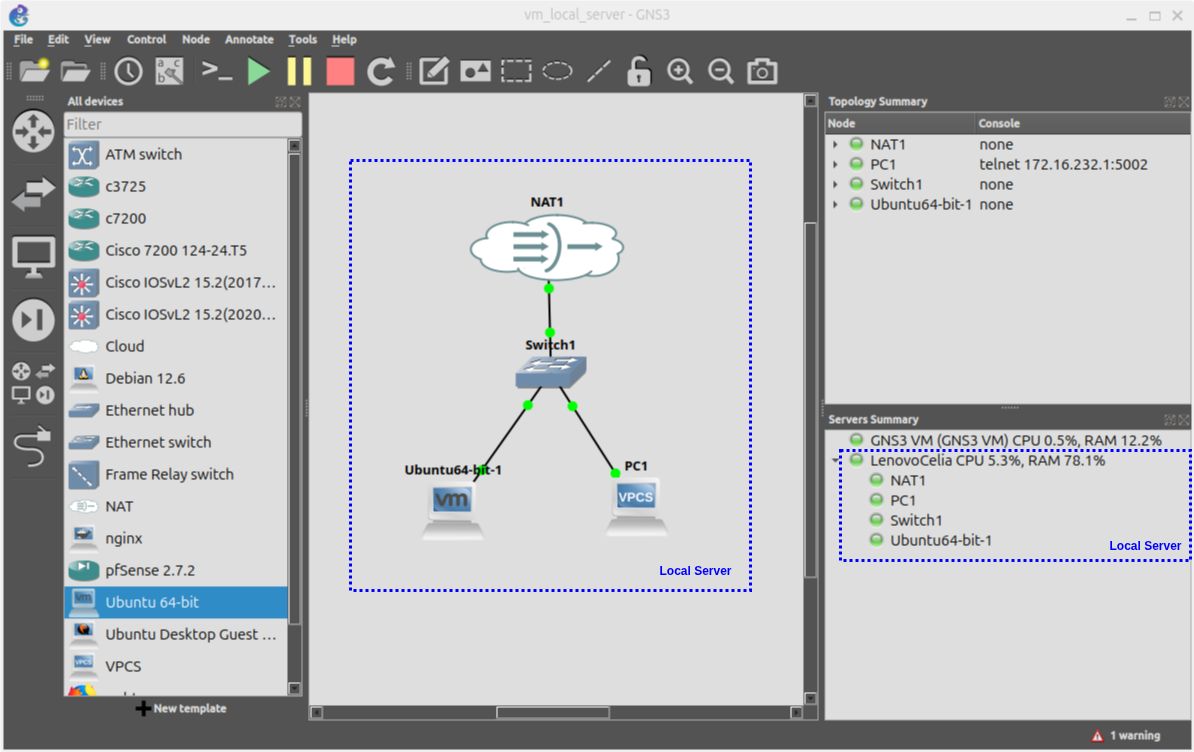

En este laboratorio vamos a interconectar una máquina virtual alojada localmente en tu ordenador en VMware, con una topología de red que se está ejecutando directamente en el servidor local de GNS3 sin utilizar la máquina virtual GNS3 VM. Lograremos conectividad total entre un PC virtual (VPC), una máquina virtual Ubuntu en VMware y daremos salida a Internet a través de un nodo NAT.

En uno de los paneles de la derecha de la interfaz de GNS3, puedes encontrar la sección Server Summary. Para esta práctica, todo el entorno se concentrará bajo el indicador de tu máquina física.

En esta sección, se puede verificar que en la máquina local (Local Server) se están ejecutando absolutamente todos los dispositivos virtuales:

-

Un nodo NAT.

-

Un VPC (Virtual PC Simulator).

-

Un switch genérico de capa 2.

-

Una máquina virtual Ubuntu descargada de OSBoxes y ejecutada en VMware.

4.2.3 Descargar una VM preconfigurada de OSBoxes

Para este laboratorio necesitaremos un sistema operativo real que actúe como cliente en nuestra topología. Utilizaremos OSBoxes para evitar instalar el sistema desde cero.

Enlace oficial:

Instrucciones:

-

Selecciona el sistema operativo: Accede al enlace web y busca la distribución Ubuntu (recomendada para esta práctica por su facilidad de uso).

-

Elige el hipervisor correcto: Asegúrate de descargar la imagen correspondiente a la pestaña VMware.

-

Descarga y descomprime: El archivo se descargará comprimido (generalmente en

.7z). Utiliza 7-Zip para extraer su contenido. Obtendrás los archivos listos para abrir directamente desde VMware Workstation o Player.

|

Credenciales por defecto Las máquinas virtuales de OSBoxes vienen con un usuario preconfigurado por defecto. Para poder iniciar sesión en tu Ubuntu utiliza: usuario: |

4.2.4 Integración de VMware en GNS3

Para que GNS3 pueda controlar la máquina de VMware e integrarla en la topología local, debemos configurar cómo gestiona las redes.

1. Configuración avanzada de VMware:

-

En la misma ventana de Preferencias, selecciona en el menú izquierdo la opción de VMware y ve a la pestaña Advanced local settings.

-

Asegúrate de que el rango de Managed VMnet interfaces cubra una cantidad suficiente (por ejemplo, de

vmnet2avmnet100). -

Verifica que la casilla “Block network traffic originating from the host OS” esté marcada.

-

Haz clic en Reset para que VMware vuelva a crear las interfaces y luego en Configure para que GNS3 les asigne permisos (acepta las solicitudes de administrador).

-

Haz clic en Apply.

2. Configuración de la plantilla de Ubuntu:

-

En el menú izquierdo de Preferencias, despliega VMware y haz clic en VMware VMs.

-

Haz clic en el botón New e importa la máquina de Ubuntu que descargaste.

-

Una vez importada, selecciónala, haz clic en Edit y ve a la pestaña Network.

-

Configura Adapters en 1 y deja el Type en

e1000. -

Asegúrate de que la casilla “Allow GNS3 to override non custom VMware adapter” esté marcada. Esto es vital para que GNS3 controle el cable.

-

Haz clic en OK en ambas ventanas para guardar todo.

4.2.5 Creación de la topología de red

Al arrastrar los elementos al área de trabajo, es crucial asegurarse de que todos se ejecutan en tu ordenador físico.

-

Arrastra un nodo NAT y un Switch Ethernet al área de trabajo. Cuando GNS3 te pregunte dónde ejecutarlos, elige tu ordenador local (Local Server).

-

Arrastra un nodo VPCS (PC1) y ejecútalo también en tu servidor Local.

-

Arrastra la máquina virtual Ubuntu importada (que por defecto se ejecutará en local).

-

Conecta todo con cables: Ubuntu al Switch, VPCS al Switch, y Switch al NAT.

|

Si el cable entre Ubuntu y el Switch te da un error, bórralo y vuélvelo a conectar. Si el error persiste, verifica que el servicio de VMware está en ejecución en tu sistema anfitrión. |

4.2.6 Configuración de IPs

El nodo NAT proporciona direcciones IP automáticamente (DHCP) para aislar la topología y dar salida a Internet.

1. Configurar el VPCS:

-

Abre la consola del PC1 y escribe:

ip dhcp -

Toma nota de la IP que le asigna el NAT.

2. Configurar la máquina Ubuntu:

-

Enciende Ubuntu desde GNS3.

-

Ve a la configuración de red gráfica (Network settings).

-

En la pestaña IPv4, asegúrate de que esté seleccionado Automatic (DHCP).

-

Apaga y vuelve a encender el interruptor de red en Ubuntu para refrescar la IP.

-

Abre una terminal y verifica tu IP con el comando

ip a.

4.2.7 Verificación de conectividad

Realiza estas pruebas desde la terminal de tu Ubuntu para confirmar el éxito del laboratorio:

-

Conectividad LAN: Ejecuta

ping <IP_DEL_VPCS>. -

Conectividad al Gateway: Ejecuta

ping 192.168.122.1o la IP que haya actuado como puerta de enlace DHCP. -

Conectividad WAN/Internet: Ejecuta

ping www.nasa.gov. Si hay respuesta, el servidor local de GNS3 está enrutando el tráfico de VMware hacia Internet con éxito.

5. Conceptos de diseño de redes seguras

El diseño de redes seguras consiste en planificar la arquitectura de una infraestructura de red de forma que la seguridad esté integrada desde el principio. Esto implica no solo desplegar dispositivos de protección como firewalls o sistemas de detección de intrusiones, sino también estructurar la red de manera que limite el impacto de un posible incidente de seguridad.

En la actualidad, los ataques informáticos no suelen producirse únicamente desde el exterior. Muchos incidentes comienzan con el compromiso de un equipo interno mediante técnicas como phishing, malware o explotación de vulnerabilidades. Por este motivo, las redes modernas deben diseñarse teniendo en cuenta que en algún momento un sistema puede verse comprometido.

El objetivo del diseño seguro es que, incluso si un atacante logra acceso a un punto de la red, no pueda desplazarse libremente por toda la infraestructura ni acceder a los sistemas críticos.

5.1 Seguridad desde el diseño

Tradicionalmente, muchas organizaciones adoptaban un enfoque reactivo hacia la seguridad. En este modelo, primero se desplegaba la infraestructura de red y posteriormente se añadían mecanismos de protección cuando aparecían problemas o incidentes.

Este enfoque presenta varios inconvenientes. Cuando la seguridad se añade después del despliegue de la red, es frecuente que la arquitectura ya esté demasiado consolidada y resulte complicado introducir cambios estructurales sin afectar al funcionamiento del sistema.

Por esta razón, en la actualidad se promueve el enfoque conocido como seguridad desde el diseño o security by design.

Este enfoque consiste en integrar los mecanismos de seguridad desde la fase de planificación de la infraestructura, de modo que la red esté preparada para resistir incidentes desde su concepción.

Algunos ejemplos de decisiones que forman parte del diseño seguro son:

-

Diseñar la red en segmentos independientes en lugar de utilizar una red plana.

-

Ubicar los servidores expuestos a Internet en zonas aisladas (DMZ).

-

Controlar el tráfico entre redes mediante firewalls o listas de control de acceso (ACL).

-

Limitar los permisos de usuarios y sistemas siguiendo el principio de mínimo privilegio.

Adoptar un enfoque de seguridad desde el diseño permite reducir significativamente los riesgos y facilita la gestión de la infraestructura a largo plazo.

5.2 Superficie de ataque en redes

La superficie de ataque de una red está formada por todos los puntos desde los que un atacante podría intentar comprometer un sistema o servicio.

Cada dispositivo conectado a la red, cada servicio expuesto y cada puerto abierto representan un posible vector de ataque.

Entre los elementos que contribuyen a aumentar la superficie de ataque se encuentran:

-

Servicios de red expuestos innecesariamente.

-

Puertos abiertos sin control.

-

Equipos obsoletos o sin actualizar.

-

Configuraciones incorrectas de dispositivos de red.

-

Accesos remotos sin mecanismos de autenticación fuertes.

Cuanto mayor sea la superficie de ataque de una infraestructura, mayor será la probabilidad de que un atacante encuentre una vulnerabilidad explotable.

Por este motivo, uno de los objetivos fundamentales del diseño de redes seguras es reducir la superficie de ataque al mínimo posible.

Esto se logra aplicando medidas como:

-

Deshabilitar servicios que no sean necesarios.

-

Restringir el acceso a los sistemas críticos.

-

Segmentar la red en múltiples zonas de seguridad.

-

Monitorizar el tráfico de red para detectar comportamientos anómalos.

Reducir la superficie de ataque no elimina completamente el riesgo, pero dificulta enormemente el trabajo de los atacantes.

5.3 Principios de diseño de redes seguras

El diseño de redes seguras se basa en una serie de principios que guían la forma en la que se estructura una infraestructura de red.

5.3.1 Segmentación de red

La segmentación de red consiste en dividir la infraestructura en diferentes zonas o subredes aisladas entre sí.

En una red plana, todos los dispositivos pueden comunicarse directamente entre ellos. Esto facilita enormemente el movimiento lateral de un atacante que haya comprometido uno de los equipos.

La segmentación reduce este riesgo al limitar la comunicación entre diferentes partes de la red. Para que el tráfico pase de una zona a otra debe atravesar dispositivos de control como routers o firewalls.

5.3.2 Defensa en profundidad

El principio de defensa en profundidad establece que la seguridad no debe depender de un único mecanismo de protección.

En su lugar, se deben desplegar múltiples capas de seguridad, de modo que si una de ellas falla, las demás continúen protegiendo el sistema.

En una red empresarial, estas capas pueden incluir:

-

Segmentación mediante VLANs.

-

Firewalls perimetrales.

-

Sistemas de detección de intrusiones.

-

Autenticación fuerte.

-

Monitorización de tráfico.

Este enfoque dificulta que un atacante pueda comprometer completamente la infraestructura.

5.3.3 Principio de mínimo privilegio

El principio de mínimo privilegio (Principle of Least Privilege, PoLP) establece que cada usuario, aplicación o sistema debe disponer únicamente de los permisos estrictamente necesarios para realizar su función.

En el contexto de redes, esto significa que no todas las máquinas deben poder comunicarse con todas las demás.

Por ejemplo:

-

Los equipos de los empleados no deberían acceder directamente a los servidores de bases de datos.

-

Los servidores de una DMZ no deberían iniciar conexiones hacia la red interna.

Aplicar este principio reduce considerablemente el riesgo de movimiento lateral dentro de la red.

5.3.4 Reducción de la superficie de ataque

Otro principio fundamental es limitar al máximo los elementos expuestos al exterior.

Esto implica:

-

Eliminar servicios innecesarios.

-

Cerrar puertos que no se utilicen.

-

Limitar los accesos remotos.

-

Aislar los sistemas críticos.

Cuantos menos servicios estén disponibles, menor será la probabilidad de que aparezcan vulnerabilidades explotables.

|

La “Sombra de IPv6” (Shadowing) Un aspecto crítico a menudo ignorado es el protocolo IPv6. Casi todos los sistemas operativos modernos (Linux, Windows, Android) lo tienen habilitado por defecto. Si tu firewall y tus reglas de red solo se centran en IPv4, el tráfico IPv6 podría estar fluyendo “en la sombra” sin ser inspeccionado, permitiendo a un atacante evadir los controles de seguridad. Como buena práctica de bastionado, si no vas a gestionar IPv6 de forma explícita, se recomienda deshabilitarlo en todos los niveles. |

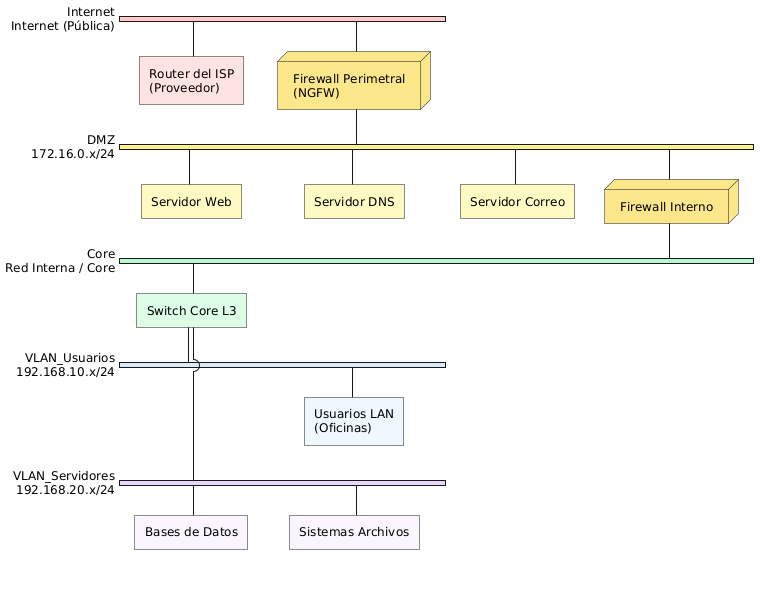

5.4 Arquitectura típica de una red empresarial

Las redes empresariales modernas suelen organizarse en diferentes zonas de seguridad, cada una con un nivel de confianza distinto.

Estas zonas permiten controlar el flujo de tráfico y aplicar políticas de seguridad específicas para cada área de la infraestructura.

Una arquitectura típica suele incluir las siguientes zonas.

5.4.1 Red externa (WAN / Internet)

Esta zona representa todas las redes que están fuera del control de la organización, principalmente Internet.

Desde el punto de vista de seguridad, esta zona se considera completamente hostil.

Por este motivo, el tráfico que proviene de Internet debe pasar obligatoriamente por dispositivos de control como firewalls perimetrales, que se encargan de filtrar las conexiones entrantes.

5.4.2 Zona desmilitarizada (DMZ)

La DMZ (Demilitarized Zone) es una red intermedia situada entre Internet y la red interna.

En esta zona se ubican los servidores que deben ofrecer servicios públicos, como por ejemplo:

-

Servidores web.

-

Servidores de correo.

-

Servidores DNS.

El objetivo de la DMZ es aislar estos sistemas del resto de la red corporativa.

Si un atacante compromete un servidor de la DMZ, no debería poder acceder directamente a los sistemas internos.

5.4.3 Red interna (LAN)

La red interna es la zona de mayor confianza de la organización.

En ella se encuentran:

-

Los equipos de los usuarios.

-

Servidores internos.

-

Sistemas de almacenamiento.

-

Servicios corporativos.

Aun así, la red interna no debería ser completamente plana. Es recomendable segmentarla en múltiples VLANs o subredes para separar distintos departamentos o tipos de sistemas.

5.5 Componentes de seguridad de una red

Para implementar una arquitectura de red segura se utilizan diferentes dispositivos y tecnologías que trabajan conjuntamente.

5.5.1 Routers

Los routers se encargan de interconectar diferentes redes y decidir por dónde deben circular los paquetes de datos.

Además de su función de enrutamiento, muchos routers pueden aplicar políticas de filtrado mediante listas de control de acceso (ACL).

5.5.2 Switches

Los switches permiten interconectar múltiples dispositivos dentro de una red local.

En redes modernas, los switches también pueden desempeñar funciones de seguridad como:

-

Creación de VLANs para segmentar la red.

-

Control de acceso a puertos.

-

Limitación del tráfico de difusión.

5.5.3 Firewalls

Los firewalls son dispositivos especializados en controlar el tráfico entre distintas redes.

Su función principal es permitir o bloquear conexiones en función de políticas de seguridad definidas por los administradores.

Los firewalls modernos utilizan técnicas de inspección avanzada que permiten analizar el estado de las conexiones y detectar comportamientos sospechosos.

5.5.4 Sistemas de monitorización y detección

Además de prevenir accesos no autorizados, es fundamental detectar posibles incidentes de seguridad.

Para ello se utilizan herramientas de monitorización que permiten analizar el tráfico de red y registrar eventos relevantes.

Entre estas herramientas se encuentran:

-

Sistemas de detección de intrusiones (IDS).

-

Sistemas de prevención de intrusiones (IPS).

-

Plataformas de análisis de tráfico.

Estos sistemas permiten identificar actividades sospechosas y reaccionar rápidamente ante posibles ataques.

5.6 Modelos modernos de seguridad (Zero Trust)

Durante muchos años, la seguridad de las redes corporativas se basó en el llamado modelo perimetral. En este enfoque, la red se divide en dos grandes zonas: (1) el interior de la organización, considerado confiable, y (2) el exterior, principalmente Internet, considerado hostil. El firewall perimetral actúa como la principal barrera de protección entre ambos entornos.

Sin embargo, este modelo presenta limitaciones importantes en el contexto actual. Las organizaciones modernas utilizan servicios en la nube, dispositivos móviles, acceso remoto y entornos distribuidos. Además, muchas brechas de seguridad comienzan con la comprometación de un equipo interno, lo que permite a un atacante desplazarse lateralmente dentro de la red.

Para hacer frente a estos desafíos ha surgido el modelo Zero Trust, un enfoque de seguridad que parte de una premisa fundamental:

No confiar en ningún dispositivo, usuario o red por defecto, independientemente de su ubicación.

En una arquitectura Zero Trust, cada solicitud de acceso debe ser verificada, autenticada y autorizada, incluso si proviene de la red interna.

Principios del modelo Zero Trust

El enfoque Zero Trust se basa en varios principios clave:

-

Verificación continua: Cada acceso a un recurso debe verificarse mediante mecanismos de autenticación y autorización. Esto puede incluir autenticación multifactor (MFA), certificados digitales o controles de identidad.

-

Acceso basado en identidad: Las decisiones de acceso se toman en función de la identidad del usuario, del dispositivo utilizado y del contexto de la conexión, en lugar de basarse únicamente en la ubicación dentro de la red.

-

Microsegmentación: La red se divide en segmentos muy pequeños para limitar el movimiento lateral. Cada segmento aplica políticas de acceso específicas que restringen la comunicación entre sistemas.

-

Principio de mínimo privilegio: Los usuarios y sistemas solo pueden acceder a los recursos que necesitan para realizar su función. Esto reduce el impacto de posibles compromisos de seguridad.

Zero Trust en el diseño de redes

Aunque Zero Trust implica cambios en múltiples capas de la infraestructura tecnológica, algunos de sus principios pueden aplicarse directamente en el diseño de redes seguras, por ejemplo:

-

Segmentar la red en múltiples VLANs o subredes.

-

Aplicar controles estrictos entre segmentos.

-

Evitar redes internas completamente abiertas.

-

Registrar y monitorizar continuamente el tráfico.

Este enfoque refuerza la idea de que la seguridad no debe depender únicamente del perímetro de la red, sino que debe integrarse en toda la infraestructura.

5.7 Buenas prácticas de diseño de redes seguras

El diseño de redes seguras no se limita a la implementación de dispositivos de seguridad. También implica adoptar una serie de buenas prácticas arquitectónicas que reduzcan los riesgos y faciliten la gestión de la infraestructura a largo plazo.

A continuación se presentan algunas de las recomendaciones más importantes.

Segmentación por niveles de confianza

Una de las prácticas más importantes consiste en dividir la red en diferentes zonas según su nivel de confianza.

Por ejemplo:

-

Red interna de usuarios.

-

Red de servidores.

-

Red de administración.

-

Red de invitados.

-

Zona desmilitarizada (DMZ).

Cada zona debe tener reglas de comunicación claramente definidas. Esto permite limitar el acceso entre segmentos y reducir el impacto de posibles incidentes.

Aplicación del principio de mínimo privilegio

Las políticas de red deben permitir únicamente las comunicaciones necesarias para el funcionamiento de los sistemas.

Por ejemplo:

-

Un servidor web no debería poder acceder directamente a la base de datos si no es necesario.

-

Los equipos de invitados no deberían tener acceso a la red interna.

-

Los accesos administrativos deberían estar restringidos a redes específicas.

Aplicar este principio reduce significativamente la superficie de ataque.

Reducción de la superficie de ataque

Otra buena práctica consiste en minimizar el número de servicios expuestos en la red.

Esto incluye:

-

Deshabilitar servicios innecesarios.

-

Cerrar puertos que no se utilicen.

-

Limitar los accesos remotos.

-

Evitar configuraciones por defecto.

Cuantos menos servicios estén disponibles, menor será la probabilidad de que existan vulnerabilidades explotables.

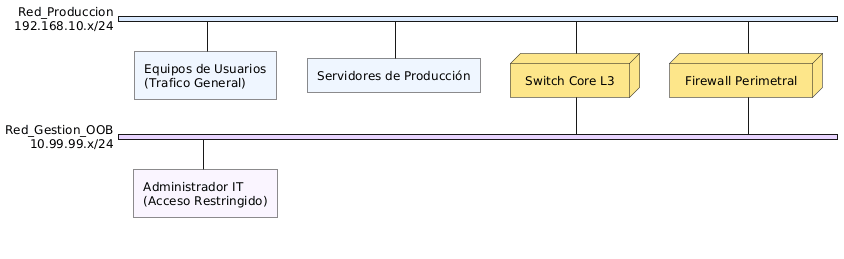

Separación de redes de gestión

Las interfaces de administración de dispositivos críticos como routers, switches o firewalls deben estar situadas en redes de gestión separadas.

De esta forma se evita que usuarios o dispositivos de la red general puedan acceder directamente a los sistemas de administración de la infraestructura.

En entornos profesionales, estas redes de gestión suelen estar accesibles únicamente desde equipos de administración específicos.

Monitorización y registro de actividad

Un diseño de red seguro debe incluir mecanismos que permitan detectar comportamientos anómalos o incidentes de seguridad.

Para ello es importante:

-

Registrar eventos relevantes en los dispositivos de red.

-

Analizar el tráfico de red.

-

Utilizar herramientas de monitorización y análisis.

La visibilidad sobre el tráfico y los eventos de red es fundamental para responder de forma rápida ante posibles incidentes.

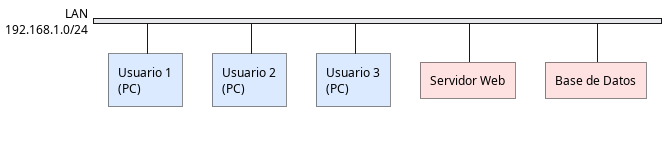

6. Segmentación de red

Uno de los pilares fundamentales en el diseño de redes seguras es la segmentación de red. Esta técnica consiste en dividir una infraestructura de red en múltiples zonas independientes, de manera que el tráfico entre ellas pueda controlarse y monitorizarse.

En redes mal diseñadas, todos los dispositivos suelen pertenecer a una misma red lógica. Esto permite que cualquier equipo pueda comunicarse directamente con cualquier otro. Aunque este modelo simplifica la configuración inicial, también facilita enormemente el movimiento lateral de un atacante en caso de que uno de los equipos sea comprometido.

La segmentación introduce barreras lógicas entre distintos grupos de sistemas, obligando a que el tráfico pase por dispositivos de control como routers o firewalls, donde pueden aplicarse políticas de seguridad.

En este apartado veremos las técnicas más utilizadas para implementar la segmentación de red:

-

VLANs, que permiten dividir la red a nivel de enlace de datos (Capa 2 del modelo OSI).

-

Subredes IP, que organizan el direccionamiento y permiten enrutar el tráfico entre segmentos.

6.1 Qué es la segmentación de red

La segmentación de red consiste en dividir una red grande en múltiples segmentos más pequeños y aislados entre sí. Cada segmento puede tener sus propias políticas de seguridad, reglas de acceso y configuraciones de red.

Red plana vs red segmentada

En una red plana, todos los dispositivos pertenecen al mismo dominio de red. Esto significa que cualquier equipo puede comunicarse directamente con cualquier otro dispositivo de la infraestructura.

Este diseño presenta varios problemas de seguridad:

-

Un atacante que comprometa un equipo puede escanear toda la red.

-

Es posible realizar movimiento lateral hacia otros sistemas.

-

Los ataques de propagación automática, como algunos tipos de malware o ransomware, pueden extenderse rápidamente.

En contraste, una red segmentada divide la infraestructura en múltiples redes lógicas. Cada segmento se comunica con los demás a través de dispositivos de enrutamiento o filtrado.

Esto permite controlar el tráfico entre segmentos y aplicar políticas como:

-

Bloquear comunicaciones innecesarias.

-

Permitir únicamente determinados servicios.

-

Monitorizar el tráfico entre zonas.

Beneficios de seguridad

La segmentación ofrece varias ventajas importantes en el ámbito de la ciberseguridad:

-

Reducción de la superficie de ataque: Los sistemas solo están expuestos a los dispositivos que pertenecen a su mismo segmento o a aquellos que tienen acceso autorizado.

-

Contención de incidentes: Si un equipo es comprometido, el atacante no podrá desplazarse libremente por toda la red.

-

Mejora del rendimiento: La segmentación reduce el tráfico de difusión (broadcast), lo que mejora el rendimiento general de la red.

-

Aplicación de políticas de seguridad: Permite aplicar reglas específicas para controlar el tráfico entre distintos departamentos o servicios.

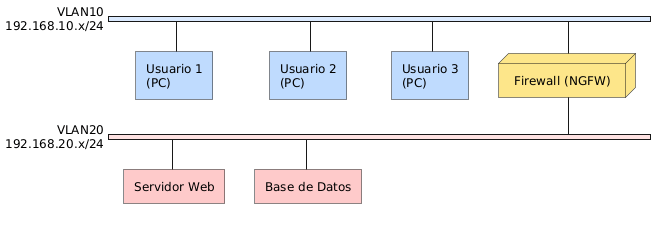

6.2 VLAN (Virtual LAN)

Una VLAN (Virtual Local Area Network) es una técnica que permite dividir un switch físico en múltiples redes lógicas independientes.

Aunque todos los dispositivos estén conectados al mismo hardware, una VLAN hace que se comporten como si estuvieran conectados a switches distintos.

Concepto de VLAN

Cuando un switch recibe una trama Ethernet, normalmente la envía a todos los puertos dentro de su dominio de difusión. Esto significa que todos los equipos conectados al switch participan en el mismo dominio de broadcast.

Las VLANs permiten crear múltiples dominios de broadcast dentro del mismo switch, separando el tráfico entre diferentes grupos de dispositivos.

Por ejemplo, en una empresa podemos crear VLANs para distintos departamentos:

| VLAN | Departamento | Subred |

|---|---|---|

VLAN 10 |

Administración |

192.168.10.0/24 |

VLAN 20 |

Recursos Humanos |

192.168.20.0/24 |

VLAN 30 |

Desarrollo |

192.168.30.0/24 |

Los equipos de cada VLAN solo podrán comunicarse con los dispositivos que pertenezcan a su misma VLAN.

Dominios de broadcast

Un dominio de broadcast es el conjunto de dispositivos que reciben mensajes de difusión enviados por un equipo de la red.

Ejemplos de mensajes broadcast:

-

Solicitudes ARP.

-

Mensajes DHCP Discover.

En una red plana, todos los equipos reciben estos mensajes. Esto puede generar un gran volumen de tráfico innecesario.

Las VLANs dividen la red en múltiples dominios de broadcast, lo que mejora el rendimiento y reduce el impacto de ciertos tipos de ataques.

Aislamiento lógico

Una de las principales ventajas de las VLANs es que proporcionan aislamiento lógico entre dispositivos.

Dos equipos conectados al mismo switch físico pero en VLANs diferentes no pueden comunicarse directamente.

Para que puedan hacerlo es necesario un dispositivo de Capa 3, como un router o un firewall, que enrute el tráfico entre ambas redes.

Este punto es fundamental en el diseño de redes seguras, ya que permite inspeccionar y controlar el tráfico entre distintos segmentos de la infraestructura.

6.3 Puertos Access y Trunk

Para que las VLANs funcionen correctamente, los puertos de un switch deben configurarse en diferentes modos de operación.

Los dos modos más importantes son:

-

Puertos de acceso (access ports).

-

Puertos troncales (trunk ports).

Puertos Access

Un puerto de acceso es un puerto del switch que pertenece exclusivamente a una VLAN.

Este tipo de puerto se utiliza para conectar dispositivos finales, como ordenadores, impresoras o servidores.

El dispositivo conectado no necesita conocer la existencia de las VLANs. El switch se encarga de asociar automáticamente el tráfico del puerto con la VLAN correspondiente.

Puertos Trunk

Un puerto troncal permite transportar tráfico de múltiples VLANs a través de un único enlace físico.

Este tipo de puerto se utiliza normalmente para conectar switches entre sí, switches con routers o switches con firewalls.

Para que el tráfico de diferentes VLANs no se mezcle, cada trama Ethernet se marca con una etiqueta que identifica la VLAN a la que pertenece.

El estándar 802.1Q (dot1q)

![Formato de la trama IEEE 802.1Q. Imagen obtenida de https://es.wikipedia.org/wiki/IEEE_802.1Q[Wikipedia]](images/ethernet_802.1q.png)

El protocolo utilizado para etiquetar las tramas VLAN es el estándar IEEE 802.1Q.

Este estándar añade un campo adicional a la trama Ethernet que incluye el identificador de la VLAN (VLAN ID).

Para que el tráfico de diferentes VLANs no se mezcle al viajar por un mismo cable físico (el enlace troncal), el estándar IEEE 802.1Q se encarga de inyectar una etiqueta (tag) de 4 bytes en cada paquete de datos. Esta etiqueta contiene el número identificador de la VLAN, permitiendo que el switch o router de destino sepa exactamente a qué red pertenece cada paquete.

Cuando una trama atraviesa un enlace troncal:

-

El switch añade una etiqueta 802.1Q con el número de VLAN.

-

El dispositivo receptor lee la etiqueta.

-

La trama se entrega a la VLAN correspondiente.

Este mecanismo permite que múltiples redes lógicas compartan un mismo enlace físico sin interferir entre sí.

La VLAN Nativa

Dentro del estándar IEEE 802.1Q existe un concepto de seguridad muy importante: la VLAN Nativa.

Por definición, el tráfico de la VLAN nativa viaja por los enlaces troncales sin etiqueta.

Por defecto en los equipos Cisco, la VLAN 1 es la nativa y también la VLAN de administración predeterminada. En entornos profesionales de ciberseguridad, se considera una buena práctica cambiar la VLAN nativa a una VLAN inutilizada que no sea la 1 para prevenir ataques de salto de VLAN (VLAN Hopping).

|

Importante Los dispositivos de una VLAN no pueden comunicarse directamente con los de otra VLAN, ni siquiera si están en el mismo switch físico. Para que hablen entre sí, el tráfico debe salir del switch y pasar forzosamente por un dispositivo de Capa 3 como un router o un firewall, lo que nos da la oportunidad de auditar, bloquear o permitir ese tráfico. |

6.4 Subredes IP

Mientras que las VLANs segmentan la red a nivel de enlace de datos (Capa 2), las subredes IP permiten organizar la red a nivel de Capa 3 del modelo OSI.

Una subred define un conjunto de direcciones IP que pertenecen a la misma red lógica.

CIDR y máscaras de subred

El tamaño de una subred se define mediante la notación CIDR (Classless Inter-Domain Routing).

Por ejemplo:

192.168.10.0/24

El número /24 indica que los primeros 24 bits de la dirección IP identifican la red.

Esto equivale a una máscara de subred:

255.255.255.0

Con esta configuración, la red dispone de:

-

256 direcciones totales

-

254 direcciones utilizables para dispositivos

Las subredes permiten organizar el direccionamiento IP de forma estructurada y facilitan el enrutamiento entre diferentes segmentos de red.

Puerta de enlace (Gateway)

Para que un dispositivo pueda comunicarse con otras redes, necesita conocer la dirección de su puerta de enlace predeterminada (default gateway).

El gateway suele ser una interfaz de un router o firewall que conecta la subred con otras redes.

Por ejemplo:

| Subred | Gateway |

|---|---|

192.168.10.0/24 |

192.168.10.1 |

192.168.20.0/24 |

192.168.20.1 |

192.168.30.0/24 |

192.168.30.1 |

Cuando un dispositivo necesita enviar tráfico fuera de su propia subred, lo envía al gateway para que este lo enrute hacia su destino.

6.5 Relación entre VLANs y subredes

En el diseño de redes empresariales modernas existe una regla ampliamente aceptada: cada VLAN debe estar asociada a una única subred IP.

Este modelo se conoce como diseño 1:1 entre VLAN y subred.

Diseño 1:1 entre VLAN y subred

En este enfoque, cada VLAN tiene su propio rango de direcciones IP.

Por ejemplo:

| VLAN | Subred |

|---|---|

VLAN 10 |

192.168.10.0/24 |

VLAN 20 |

192.168.20.0/24 |

VLAN 30 |

192.168.30.0/24 |

Este diseño facilita la gestión de la red y la aplicación de políticas de seguridad.

Organización del direccionamiento

Mantener una correspondencia clara entre VLANs y subredes permite:

-

Identificar fácilmente a qué segmento pertenece un dispositivo.

-

Simplificar las configuraciones de enrutamiento.

-

Aplicar reglas de firewall de forma más sencilla.

Por ejemplo, si sabemos que la subred 192.168.20.0/24 pertenece al departamento de Recursos Humanos, podemos crear reglas de seguridad que controlen el acceso de ese departamento a otros sistemas.

Además, este modelo facilita la escalabilidad de la red, ya que permite añadir nuevos segmentos sin modificar la arquitectura existente.

| VLAN | Departamento | Subred (CIDR) | Puerta de Enlace (Gateway) | Rango para equipos (DHCP/Estático) |

|---|---|---|---|---|

VLAN 10 |

Administración |

|

|

|

VLAN 20 |

Empleados |

|

|

|

VLAN 30 |

Invitados |

|

|

|

6.6 Seguridad en Capa 2

Aunque gran parte de las estrategias de seguridad en redes se centran en Capa 3 (IP) y superiores, muchas amenazas pueden originarse en la Capa 2 del modelo OSI, donde operan tecnologías como Ethernet, switches y VLANs.

Las redes locales LAN suelen considerarse entornos de confianza, pero en realidad son especialmente vulnerables si un atacante consigue acceso físico o lógico a la red. Desde un único equipo conectado a un switch, es posible lanzar diversos ataques que permiten interceptar tráfico, suplantar servicios o acceder a redes que deberían estar aisladas.

Por este motivo, el diseño de redes seguras también debe tener en cuenta las amenazas que afectan a la infraestructura de conmutación, así como las técnicas que permiten mitigarlas.

A continuación se describen algunos de los ataques más comunes en Capa 2.

ARP Spoofing (ARP Poisoning)

El protocolo ARP (Address Resolution Protocol) se utiliza en redes IPv4 para asociar direcciones IP con direcciones MAC dentro de una red local.

Cuando un dispositivo necesita enviar un paquete a otro equipo de la misma red, primero debe conocer su dirección MAC. Para ello envía una solicitud ARP en broadcast preguntando quién tiene la dirección IP con la que se quiere comunicar.

El equipo correspondiente responde con su dirección MAC, y esta información se almacena en una tabla ARP local.

El problema es que el protocolo ARP no incluye mecanismos de autenticación, lo que permite a un atacante enviar respuestas ARP falsas.

En un ataque de ARP Spoofing, el atacante envía respuestas ARP manipuladas para asociar su propia dirección MAC con la dirección IP de otro dispositivo, como por ejemplo el gateway de la red.

De esta forma, el tráfico destinado al gateway se envía primero al atacante, que puede:

-

Interceptar los paquetes (Man-in-the-Middle).

-

Modificar el tráfico.

-

Reenviar los paquetes al destino real para evitar ser detectado.

Este tipo de ataque permite capturar credenciales, sesiones web u otra información sensible que circule por la red.

DHCP Spoofing

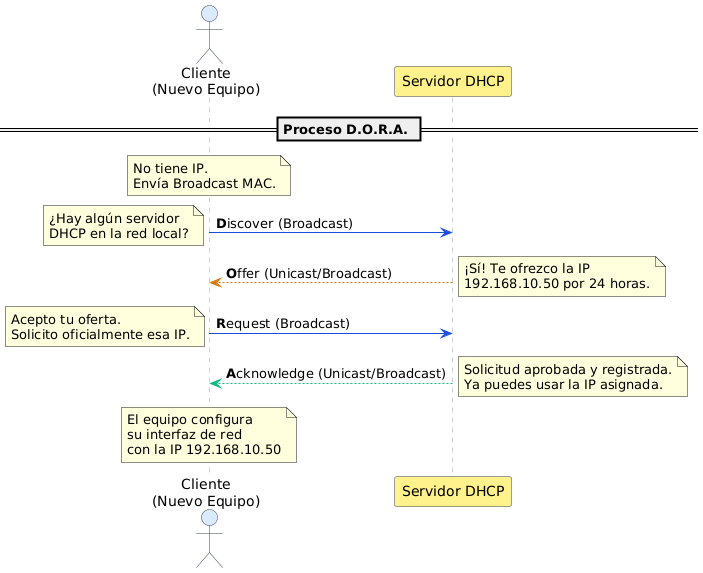

El protocolo DHCP (Dynamic Host Configuration Protocol) permite asignar automáticamente direcciones IP y otros parámetros de red a los dispositivos que se conectan a una red.

En un ataque de DHCP Spoofing, un atacante introduce un servidor DHCP falso dentro de la red.

Cuando un equipo nuevo se conecta y envía una solicitud DHCP, el servidor falso responde antes que el servidor legítimo y proporciona parámetros de red manipulados, como por ejemplo:

-

Una puerta de enlace controlada por el atacante.

-

Un servidor DNS malicioso.

Esto permite redirigir el tráfico de las víctimas hacia sistemas controlados por el atacante, facilitando ataques de interceptación de tráfico o redirección hacia sitios fraudulentos.

VLAN Hopping

Las VLANs permiten segmentar una red en múltiples redes lógicas independientes. Sin embargo, si la configuración no es correcta, es posible que un atacante consiga acceder a VLANs distintas a la suya mediante un ataque conocido como VLAN Hopping.

Existen dos técnicas principales para realizar este tipo de ataque.

-

Switch Spoofing: En este caso el atacante intenta hacerse pasar por un switch para negociar un enlace troncal con el switch real mediante protocolos como Dynamic Trunking Protocol (DTP).

Si el ataque tiene éxito, el atacante puede enviar y recibir tráfico de múltiples VLANs.

-

Double Tagging: Este ataque consiste en enviar tramas Ethernet con dos etiquetas VLAN (802.1Q). El primer switch elimina la etiqueta externa, lo que provoca que el paquete sea reenviado a una VLAN diferente en el siguiente switch.

De esta manera, el atacante puede conseguir que su tráfico llegue a redes que deberían estar aisladas.

Técnicas de mitigación

Aunque estos ataques pueden ser peligrosos, existen diversas medidas de seguridad que permiten reducir significativamente el riesgo.

Port Security

Permite limitar el número de direcciones MAC que pueden utilizar un puerto del switch. Esto ayuda a evitar ataques en los que un atacante intenta conectar múltiples dispositivos o suplantar identidades MAC.

DHCP Snooping

Esta función permite que el switch identifique qué puertos están autorizados para actuar como servidores DHCP.

Los puertos conectados a servidores DHCP legítimos se marcan como trusted, mientras que el resto se consideran untrusted. El switch bloquea cualquier respuesta DHCP procedente de puertos no autorizados.

Dynamic ARP Inspection (DAI)

Esta técnica permite verificar las respuestas ARP comparándolas con una base de datos de direcciones IP y MAC válidas. Si se detecta una respuesta ARP sospechosa, el switch puede bloquearla automáticamente.

Configuración segura de VLANs

Para prevenir ataques de VLAN Hopping es recomendable:

-

Desactivar la negociación automática de trunking (DTP).

-

Configurar manualmente los puertos trunk.

-

Utilizar una VLAN nativa distinta de la VLAN 1.

-

Limitar las VLANs permitidas en los enlaces troncales.

7. Enrutamiento entre VLANs

En el apartado anterior vimos cómo las VLANs permiten segmentar una red en múltiples dominios de broadcast independientes. Esta separación mejora la seguridad y el rendimiento de la red, pero introduce una limitación importante: los dispositivos que pertenecen a VLANs diferentes no pueden comunicarse directamente entre sí.

Para permitir la comunicación controlada entre distintas VLANs es necesario introducir dispositivos de Capa 3, como routers o switches multicapa. Estos dispositivos son capaces de analizar direcciones IP y decidir cómo debe circular el tráfico entre redes diferentes.

El proceso mediante el cual un dispositivo de Capa 3 permite la comunicación entre diferentes VLANs se conoce como enrutamiento entre VLANs.

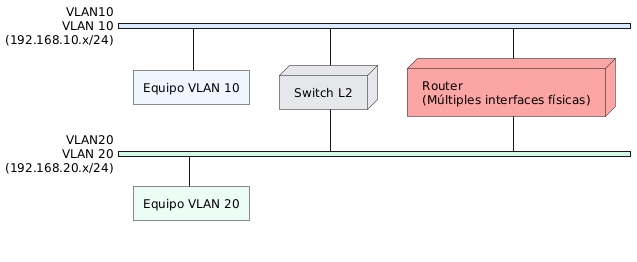

Las principales formas de realizar enrutamiento entre VLANs son:

-

Router con múltiples interfaces físicas: Cada VLAN se conecta a una interfaz distinta del router. Es una solución sencilla pero poco escalable, ya que requiere un puerto físico por cada VLAN.

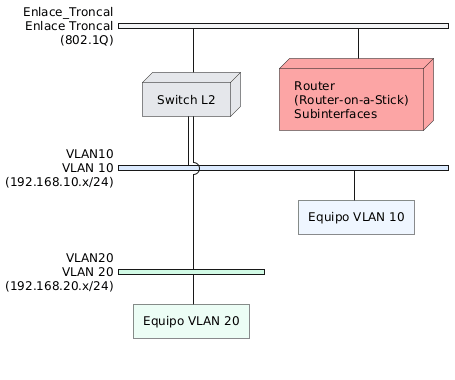

-

Router-on-a-Stick: Utiliza un único enlace troncal entre el switch y el router. El router crea subinterfaces para cada VLAN y utiliza encapsulación 802.1Q para identificar el tráfico de cada red.

-

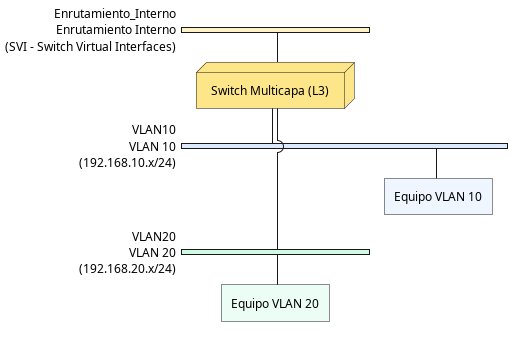

Switches de Capa 3: El propio switch realiza el enrutamiento entre VLANs mediante interfaces virtuales (SVI). Es la solución más eficiente y habitual en redes empresariales modernas.

7.1 Necesidad del enrutamiento

Cuando se utilizan VLANs en un switch de capa 2, cada VLAN funciona como una red lógica completamente independiente.

Esto significa que:

-

Los dispositivos de la VLAN 10 solo pueden comunicarse con otros dispositivos de la VLAN 10.

-

Los dispositivos de la VLAN 20 solo pueden comunicarse con otros dispositivos de la VLAN 20.

Aunque todos los equipos estén conectados al mismo switch físico, el aislamiento lógico impide que el tráfico se mezcle entre VLANs.

Este comportamiento es deseable desde el punto de vista de la seguridad, pero en muchos escenarios reales es necesario permitir cierto grado de comunicación entre segmentos de red. Por ejemplo:

-

Los usuarios deben poder acceder a servidores internos.

-

Distintos departamentos deben poder utilizar servicios compartidos.

-

Todas las VLANs deben poder salir a Internet.

Para que esto sea posible, el tráfico debe ser procesado por un dispositivo capaz de enrutar paquetes entre redes diferentes, es decir, un dispositivo de Capa 3.

7.2 Router-on-a-Stick

Una de las técnicas más utilizadas para implementar el enrutamiento entre VLANs es el método conocido como Router-on-a-Stick.

Este enfoque permite que un router enrute el tráfico de múltiples VLANs utilizando una única interfaz física.

Concepto

En lugar de conectar un cable físico por cada VLAN al router, se utiliza un enlace troncal (trunk) entre el switch y el router.

Este enlace permite transportar tráfico de múltiples VLANs a través del mismo cable, utilizando etiquetas VLAN basadas en el estándar IEEE 802.1Q.

El router recibe los paquetes etiquetados, identifica a qué VLAN pertenecen y decide cómo deben ser reenviados hacia otras redes.

Este diseño es muy común en laboratorios, redes pequeñas y entornos educativos porque permite implementar enrutamiento entre VLANs sin necesidad de hardware adicional.

Funcionamiento

El funcionamiento de Router-on-a-Stick se basa en tres elementos fundamentales:

-

Un switch de capa 2 que gestiona las VLANs.

-

Un router que realiza el enrutamiento entre redes.

-

Un enlace troncal (trunk) entre ambos dispositivos.

Cuando un equipo de una VLAN necesita comunicarse con otro dispositivo de una VLAN distinta, el tráfico sigue este proceso:

-

El equipo envía el paquete a su puerta de enlace (gateway).

-

El switch envía el tráfico al router a través del enlace troncal.

-

El router analiza la dirección IP de destino.

-

El router reenvía el paquete hacia la VLAN correspondiente.

7.3 Subinterfaces del router

Para que un router pueda enrutar el tráfico de múltiples VLANs a través de una única interfaz física, es necesario utilizar subinterfaces.

Una subinterfaz es una interfaz lógica creada dentro de una interfaz física del router.

Por ejemplo, si el router tiene una interfaz física llamada FastEthernet0/1, se pueden crear subinterfaces como:

FastEthernet0/1.10 FastEthernet0/1.20 FastEthernet0/1.30

Cada subinterfaz estará asociada a una VLAN diferente.

Encapsulación dot1Q

Para que el router pueda identificar a qué VLAN pertenece cada paquete, es necesario utilizar el estándar IEEE 802.1Q, que añade una etiqueta VLAN a cada trama Ethernet.

En el router, cada subinterfaz se configura para aceptar tráfico etiquetado con un identificador de VLAN específico mediante el comando de encapsulación dot1Q.

Por ejemplo:

encapsulation dot1Q 10

Esto indica que esa subinterfaz procesará el tráfico perteneciente a la VLAN 10.

Gateway por VLAN

Cada VLAN debe tener una puerta de enlace predeterminada (default gateway) que permita a los equipos comunicarse con otras redes.

En una arquitectura Router-on-a-Stick, el gateway de cada VLAN será la dirección IP configurada en la subinterfaz correspondiente del router.

Por ejemplo:

| VLAN | Subred | Gateway |

|---|---|---|

VLAN 10 |

192.168.10.0/24 |

192.168.10.1 |

VLAN 20 |

192.168.20.0/24 |

192.168.20.1 |

VLAN 30 |

192.168.30.0/24 |

192.168.30.1 |

Los equipos de cada VLAN utilizarán esta dirección como gateway para enviar tráfico fuera de su red.

7.5 Limitaciones y alternativas

Aunque Router-on-a-Stick es una técnica muy utilizada, presenta ciertas limitaciones.

Cuello de botella

En esta arquitectura, todo el tráfico entre VLANs debe pasar por un único enlace físico entre el switch y el router.

Esto puede generar un cuello de botella, especialmente en redes con un gran volumen de tráfico interno.

Además, el router debe procesar cada paquete, lo que puede aumentar la carga de CPU.

En redes pequeñas esto no suele ser un problema, pero en infraestructuras más grandes puede afectar al rendimiento.

Switches de capa 3

Una alternativa más eficiente consiste en utilizar switches multicapa (Layer 3 switches).

Estos dispositivos combinan las funciones de un switch tradicional con capacidades de enrutamiento.

En lugar de enviar el tráfico a un router externo, el propio switch puede realizar el enrutamiento entre VLANs utilizando interfaces virtuales conocidas como SVI (Switch Virtual Interfaces).

Las principales ventajas de los switches de capa 3 son:

-

Mayor rendimiento.

-

Menor latencia.

-

Eliminación del cuello de botella del router.

Por este motivo, en redes empresariales modernas el enrutamiento entre VLANs suele realizarse directamente en switches de capa 3 situados en la capa de distribución o núcleo de la red.

8. Comandos básicos de Cisco IOS para la gestión de VLANs

La segmentación de redes a nivel de Capa 2 mediante VLANs es una técnica fundamental para aislar el tráfico y reducir la superficie de ataque. A continuación, se detallan los comandos de Cisco IOS necesarios para su implementación y auditoría.

8.1 Creación e identificación de VLANs

El primer paso para segmentar una red es crear las VLANs. Por defecto, todos los puertos pertenecen a la VLAN 1. Para crear nuevas redes aisladas, debemos acceder al modo de configuración global.

| Comando | Descripción |

|---|---|

|

Crea una nueva VLAN y entra a su modo de configuración. Rango normal: 1-1005. Rango extendido 1006-4094. |

|

Asigna un identificador descriptivo a la VLAN. Su longitud puede ser de 1 a 32 caracteres. |

|

Aplica los cambios, incrementa el número de revisión en 1 y regresa al modo de configuración global. |

8.2 Asignación de puertos y segmentación de tráfico

Para que los dispositivos queden aislados, sus puertos correspondientes deben asignarse a la VLAN correcta. En entornos corporativos, es una buena práctica de seguridad separar el tráfico de datos (PCs) del tráfico de voz (Telefonía IP).

| Comando | Descripción |

|---|---|

|

Accede al modo de configuración de una interfaz específica. |

|

Permite aplicar configuraciones idénticas a múltiples puertos de forma simultánea. |

|

Obliga al puerto a operar en modo de acceso, previniendo negociaciones troncales no deseadas. |

|

Asigna el puerto a una VLAN de datos específica. |

|

Asigna el puerto a una VLAN de voz, permitiendo que el tráfico del teléfono viaje etiquetado (802.1Q). |

8.3 Auditoría y verificación del estado de la red

Para verificar que la segmentación lógica se ha aplicado correctamente podemos usar los siguientes comandos desde el modo EXEC privilegiado.

| Comando | Descripción |

|---|---|

|

Muestra un resumen general con todas las VLANs existentes, su estado y los puertos asignados. |

|

Filtra y muestra información exclusivamente sobre una VLAN específica. |

|

Lista las interfaces mostrando su VLAN de acceso o si operan como enlaces troncales ( |

|

Muestra información operativa detallada, incluyendo las VLANs de datos y voz de todas las interfaces o de una específica si se indica. |

|

Muestra información sobre todos los enlaces troncales operativos y la lista de VLANs permitidas en ellos. |

8.4 Operaciones de mantenimiento y mitigación de incidentes

Si se detecta un comportamiento anómalo en un segmento de red, se puede desactivar la VLAN. También es importante saber cómo limpiar las configuraciones de forma segura.

| Comando | Descripción |

|---|---|

|

Deshabilita una VLAN únicamente en el switch local, bloqueando todo su tráfico de Capa 2. |

|

Suspende o reactiva una VLAN propagando el estado a todo el dominio VTP (VLAN Trunking Protoco). Los puertos asociados dejan de pasar tráfico. |

|

Elimina un puerto de una VLAN específica y lo reasigna a la VLAN 1, que es la VLAN es la VLAN predeterminada. |

|

Elimina una VLAN de la base de datos. Los puertos asignados a ella quedarán inactivos hasta ser reasignados. |

|

Borra por completo la base de datos de VLANs de la memoria flash. Un error de sintaxis al incluir espacios puede borrar toda la flash. |

|

Guarda la configuración actual en la NVRAM para que persista tras un reinicio. |

9. Laboratorios de diseño de redes seguras

9.1 Práctica: Segmentación de redes con VLANs

En esta práctica se implementará un escenario de segmentación de red utilizando VLANs con el objetivo de separar lógicamente distintos grupos de equipos dentro de la misma infraestructura física.

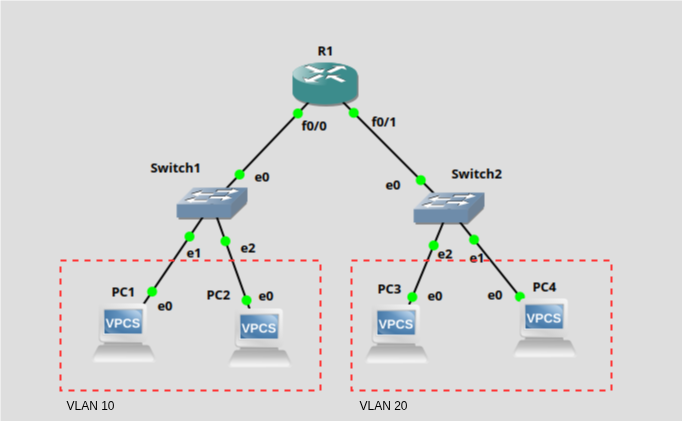

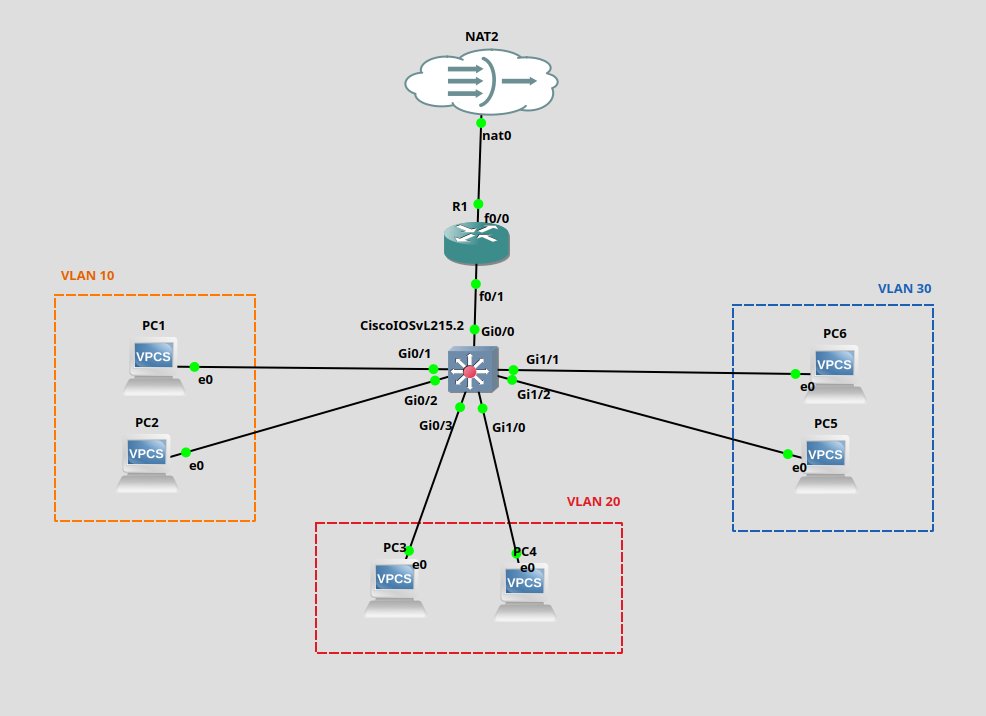

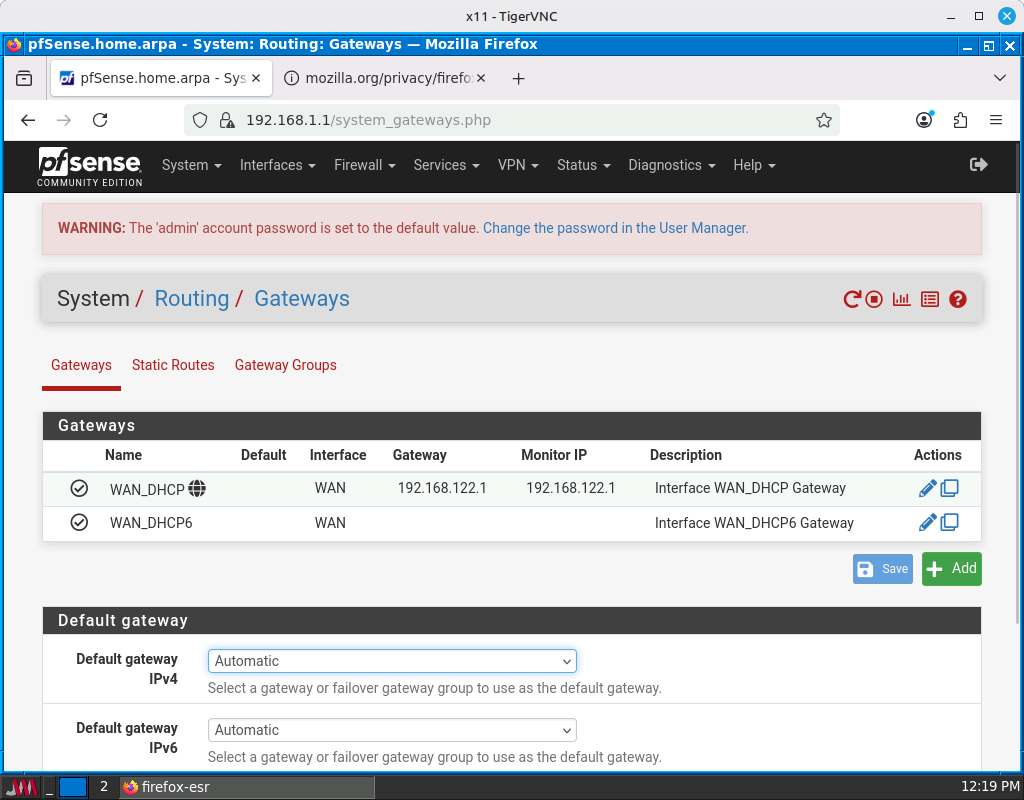

Toplología de red

En la red existen dos switches de capa 2 conectados a un router Cisco que se encargará de permitir la comunicación entre diferentes VLANs.

Cada switch tiene conectados dos equipos cliente. Los equipos se agruparán en dos VLANs diferentes para simular dos departamentos de una organización.

La topología de la red es la siguiente:

El router que utilizará en esta práctica será un Cisco 3725.

|

Debido a restricciones de licencia, las imágenes de sistemas operativos de red como Cisco IOS deben obtenerse a través de fuentes oficiales o mediante licencias educativas. |

Para los switches se utilizarán switches genéricos de capa 2.

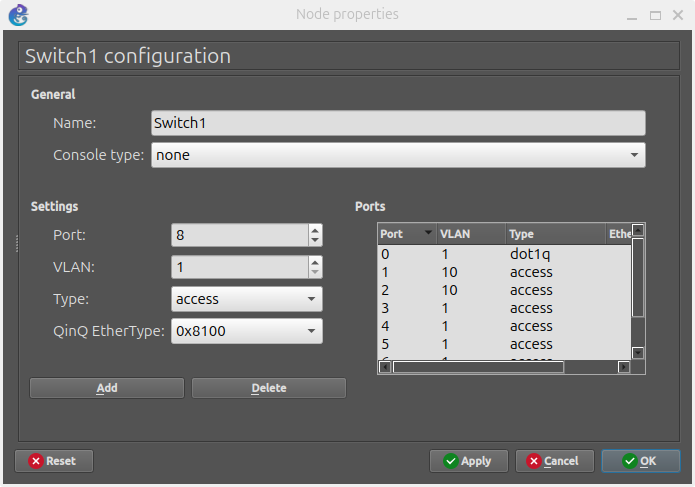

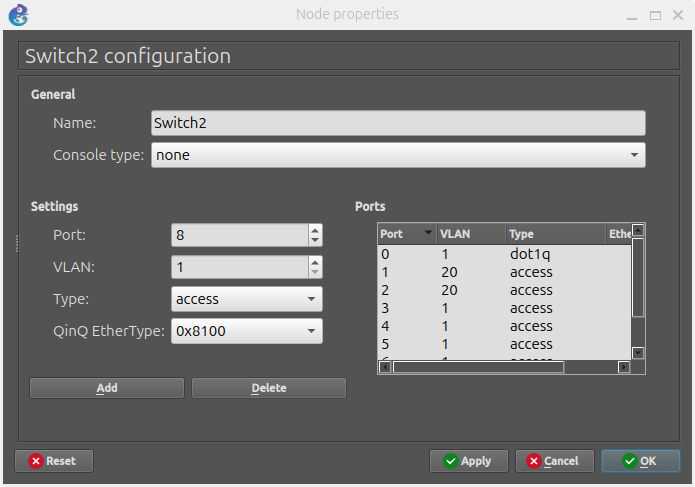

Configuración de los switches de capa 2

El puerto del switch que conecta con el router debe configurarse como enlace troncal (trunk) utilizando el estándar IEEE 802.1Q (dot1q).

Un enlace troncal permite que varias VLAN viajen por el mismo enlace físico, ya que cada trama Ethernet se etiqueta con el identificador de su VLAN correspondiente.

En esta práctica, el enlace troncal debe permitir al menos las VLAN 10 y VLAN 20, que son las que hemos creado para los distintos departamentos.

Si el puerto no está configurado como trunk 802.1Q, el router no recibirá correctamente las etiquetas de las VLAN y el enrutamiento entre VLANs (inter-VLAN routing) no funcionará.

La configuración de los switches será la siguiente:

|

Es muy importante poner en la configuración del switch que el puerto que conecta con el router es de tipo dot1q (trunk 802.1Q), esto permite el tráfico de múltiples VLANs a través de un único enlace físico. Además, debe configurar que ese mismo puerto pertenece a la VLAN nativa 1. |

Organización de la red

Se definirá la siguiente segmentación y cada VLAN utilizará una subred IP diferente:

| VLAN | Departamento | Subred | Equipos Asignados |

|---|---|---|---|

VLAN 10 |

Administración |

|

PC1, PC2 |

VLAN 20 |

Desarrollo |

|

PC3, PC4 |

Tareas a realizar

Deberá realizar las siguientes tareas.

Paso 1: Configuración de los Switches Genéricos

En GNS3, al usar el switch básico integrado, debes hacer clic derecho sobre él y seleccionar Configure.

-

Asigna los puertos de acceso de los PCs a la VLAN 10 o 20 según corresponda.

-

En el puerto que conecta el switch con el router, asegúrate de marcarlo como tipo dot1q (802.1Q) y asignarle la VLAN 1. Si omites este paso, el enlace troncal no funcionará y el router no entenderá las etiquetas de las VLANs.

Paso 2: Asignación de IPs a los clientes (VPCS)

Abre la consola de cada PC y asígnale una IP estática dentro de su subred, indicando que el router será su puerta de enlace (Gateway). Por ejemplo, para el PC1: ip 192.168.10.10 255.255.255.0 192.168.10.1

Paso 3: Configuración del Router (Inter-VLAN Routing)

Deberás acceder a la CLI del router Cisco 3725 y configurar subinterfaces (ej. FastEthernet0/0.10 y 0/0.20). Cada subinterfaz actuará como el Gateway de su respectiva VLAN mediante encapsulación 802.1Q.

Paso 4: Verificación y Pruebas

-

Realiza un

pingdesde PC1 (VLAN 10) hacia PC2 (VLAN 10). La conexión debe ser exitosa, y el tráfico no pasa por el router. -

Realiza un

pingdesde PC1 (VLAN 10) hacia PC3 (VLAN 20). La conexión debe ser exitosa, confirmando que el router está enrutando el tráfico entre las distintas subredes de forma correcta.

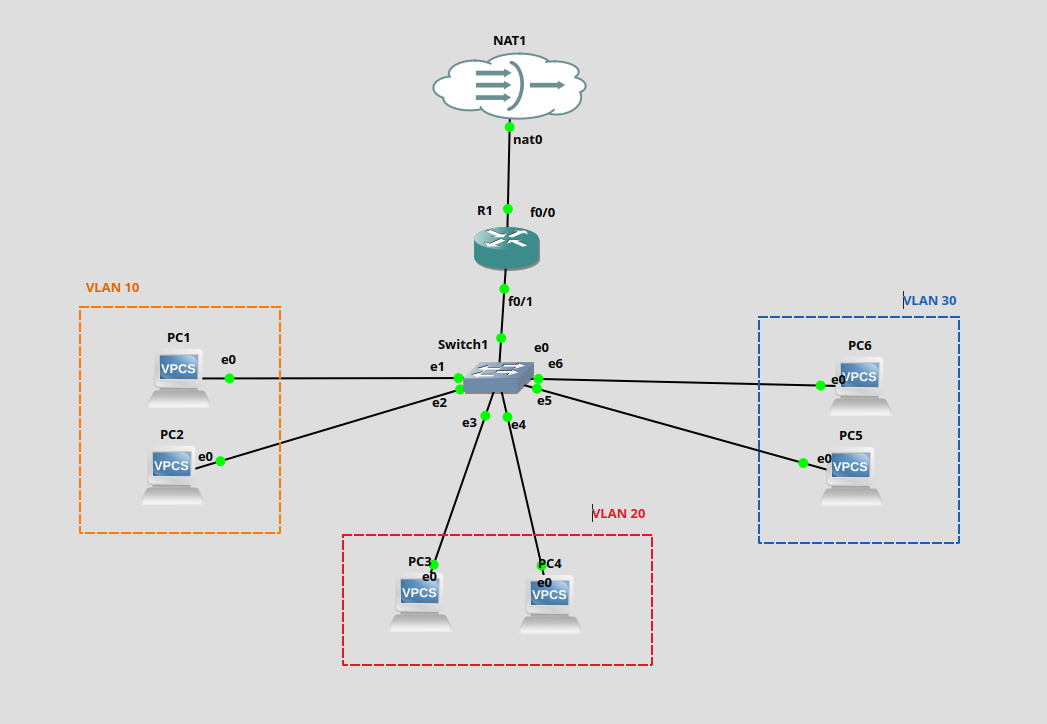

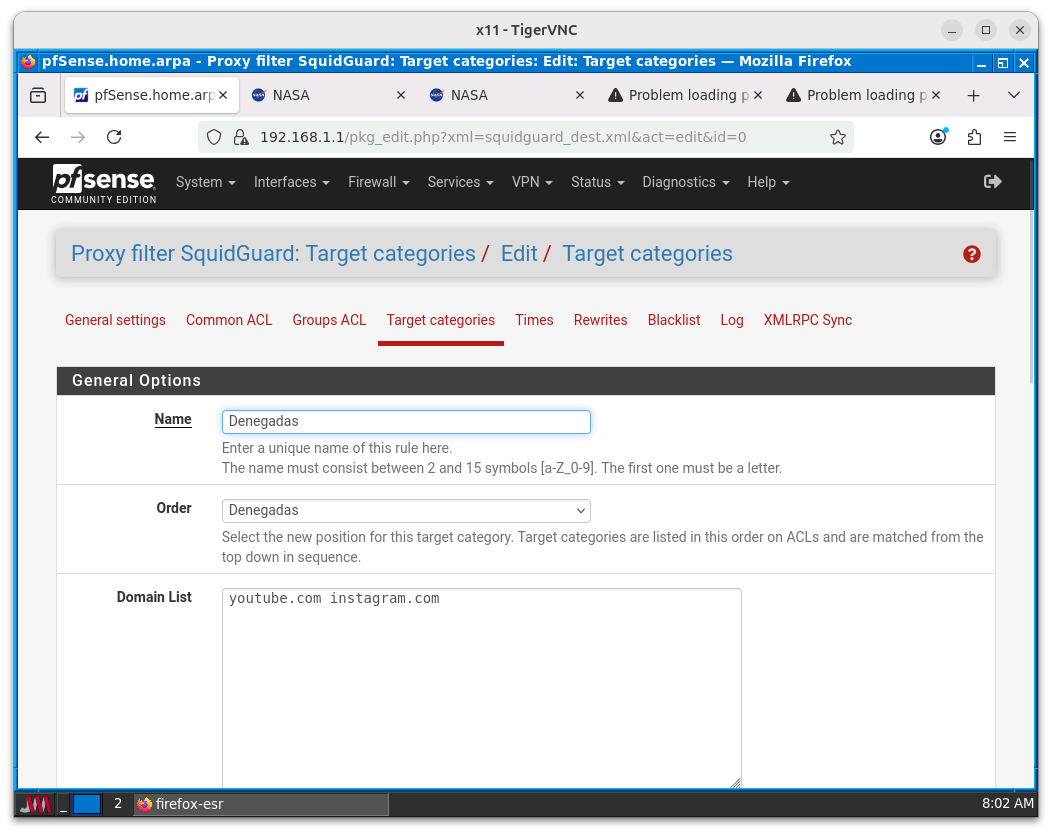

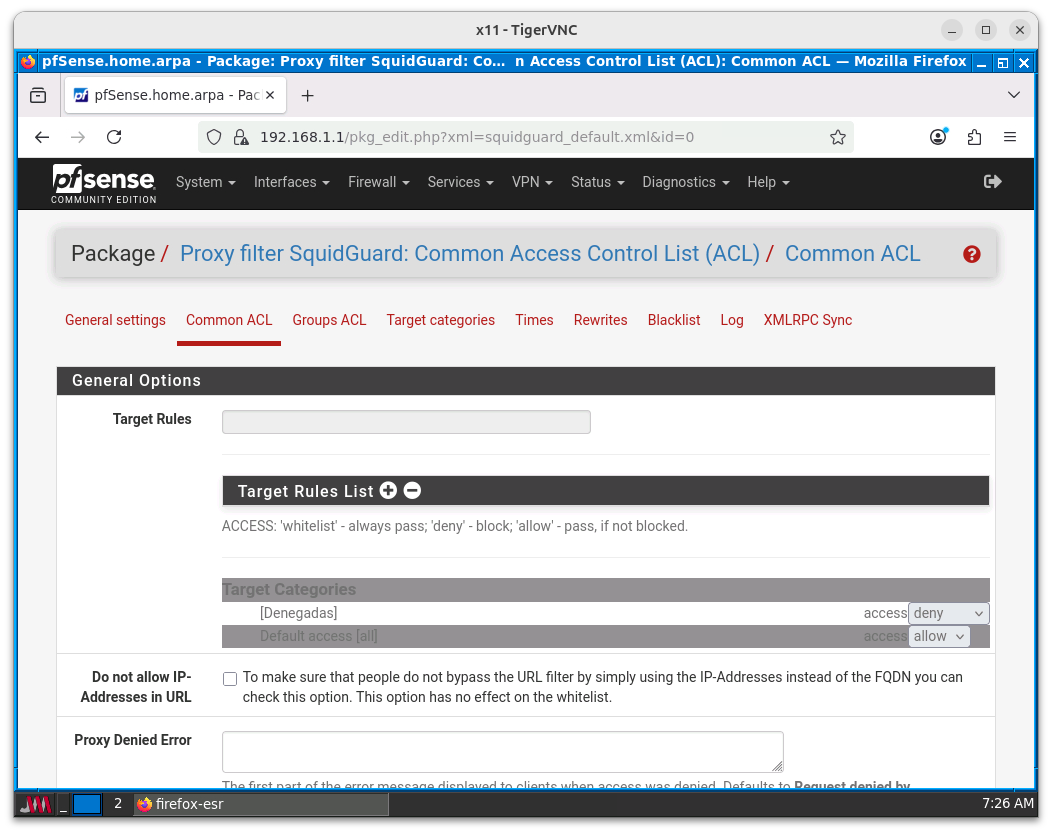

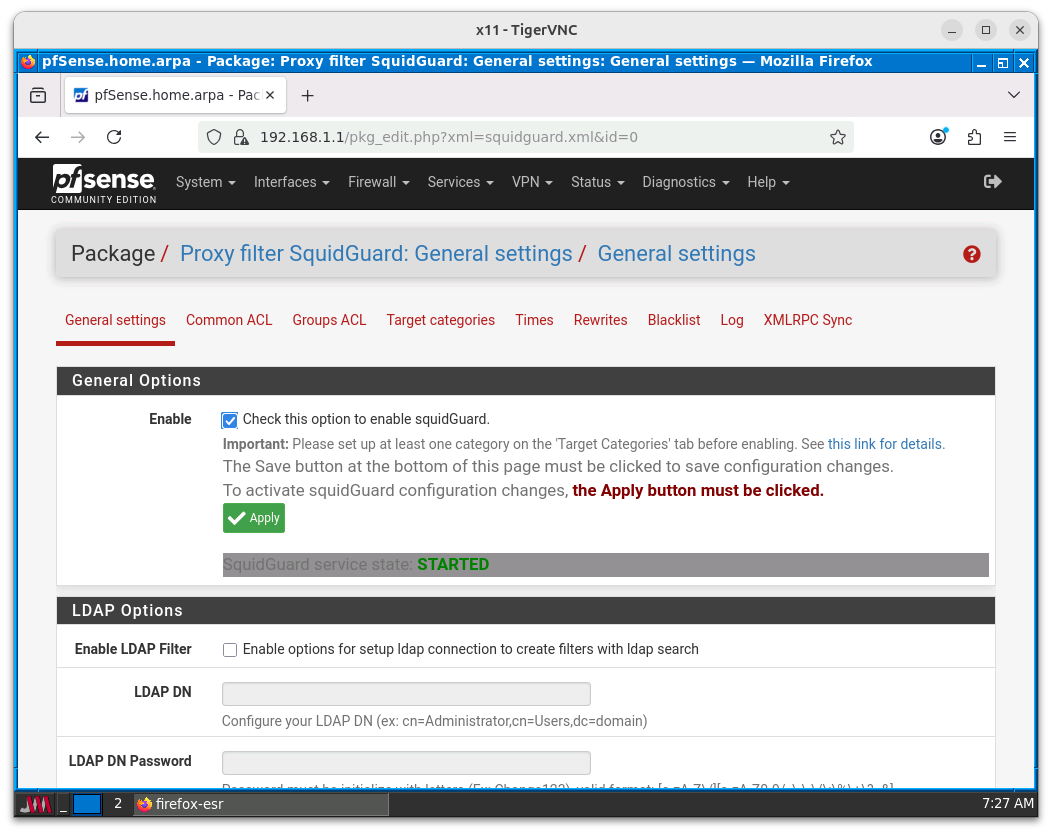

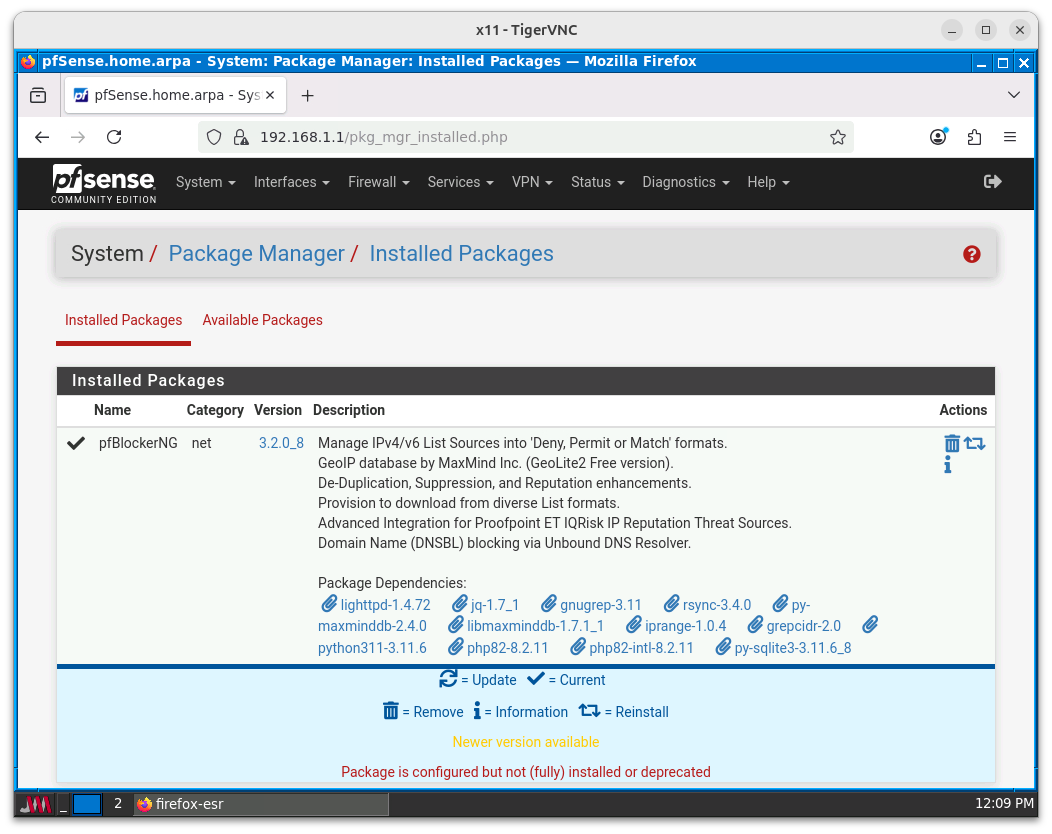

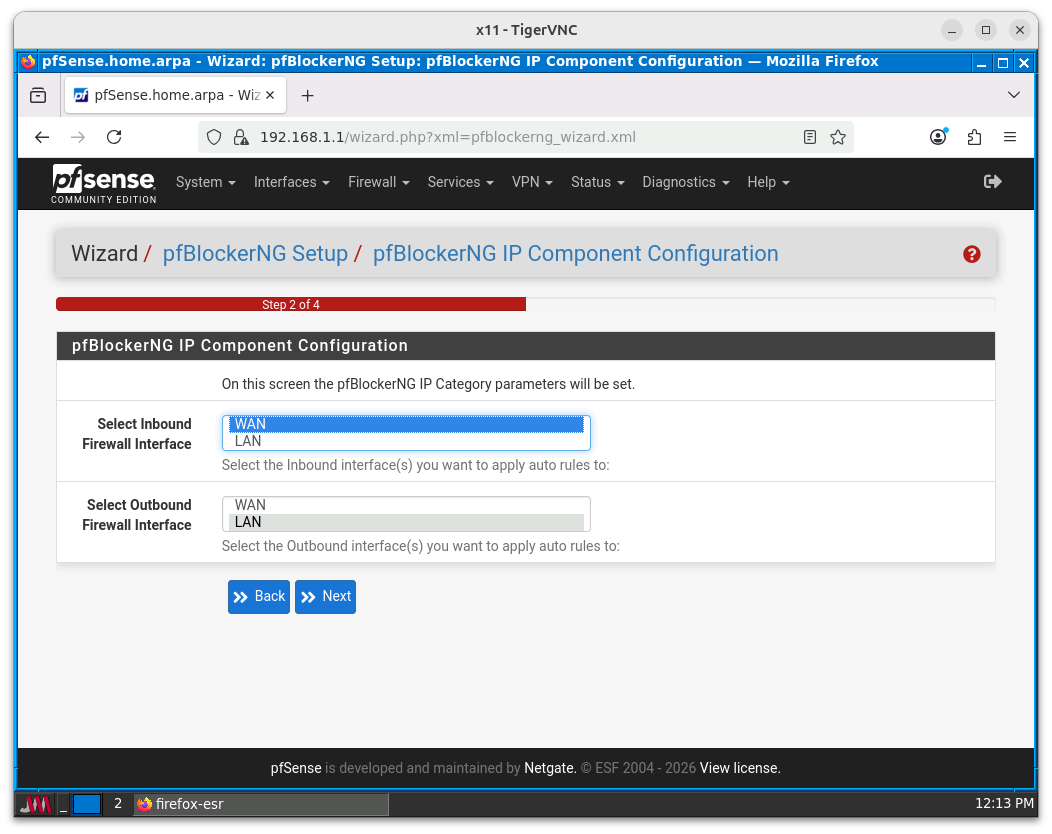

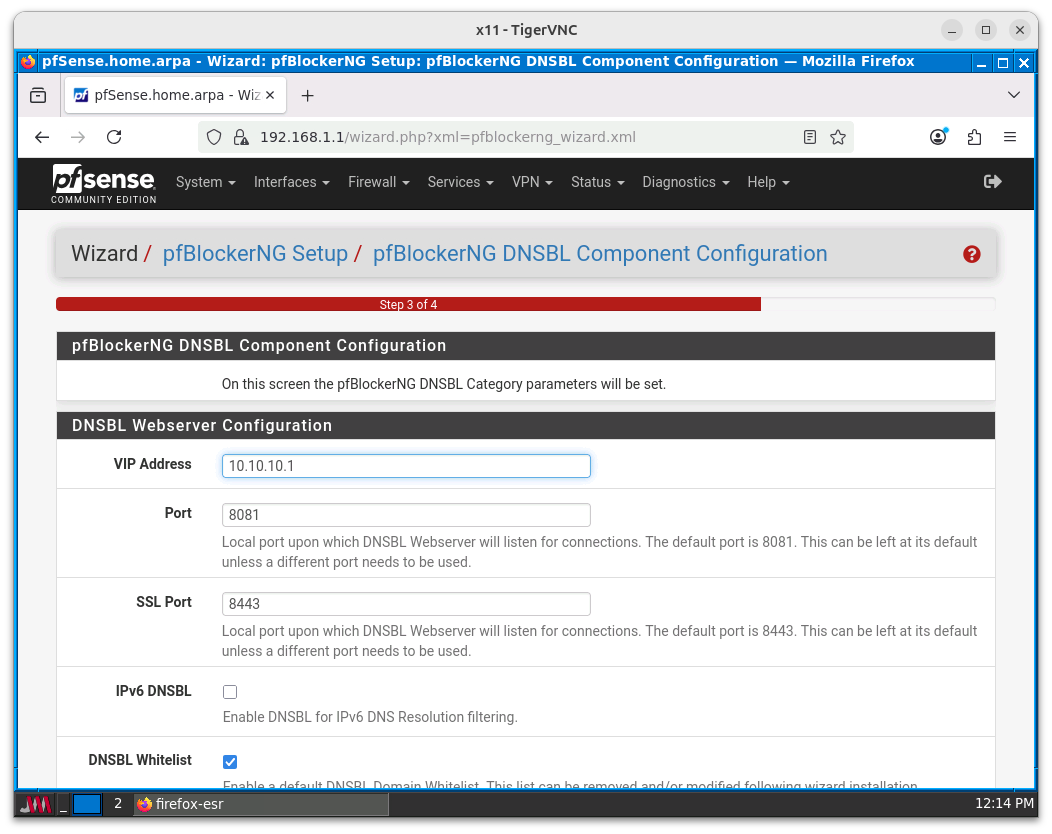

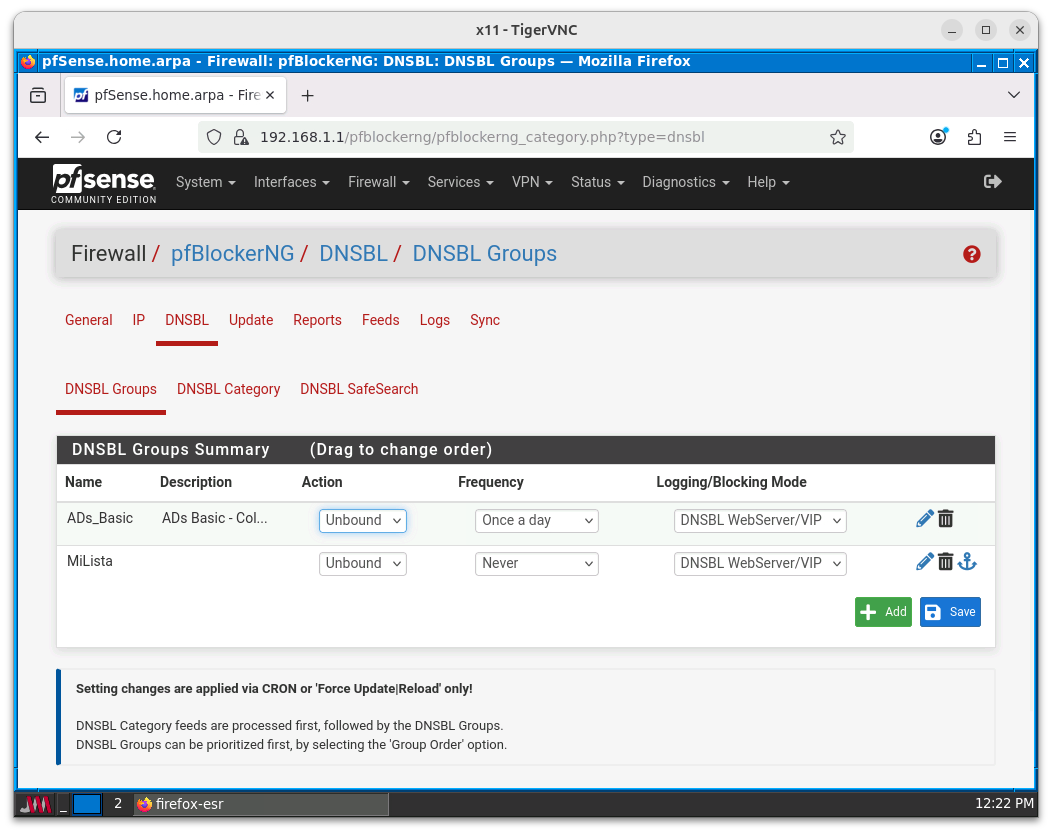

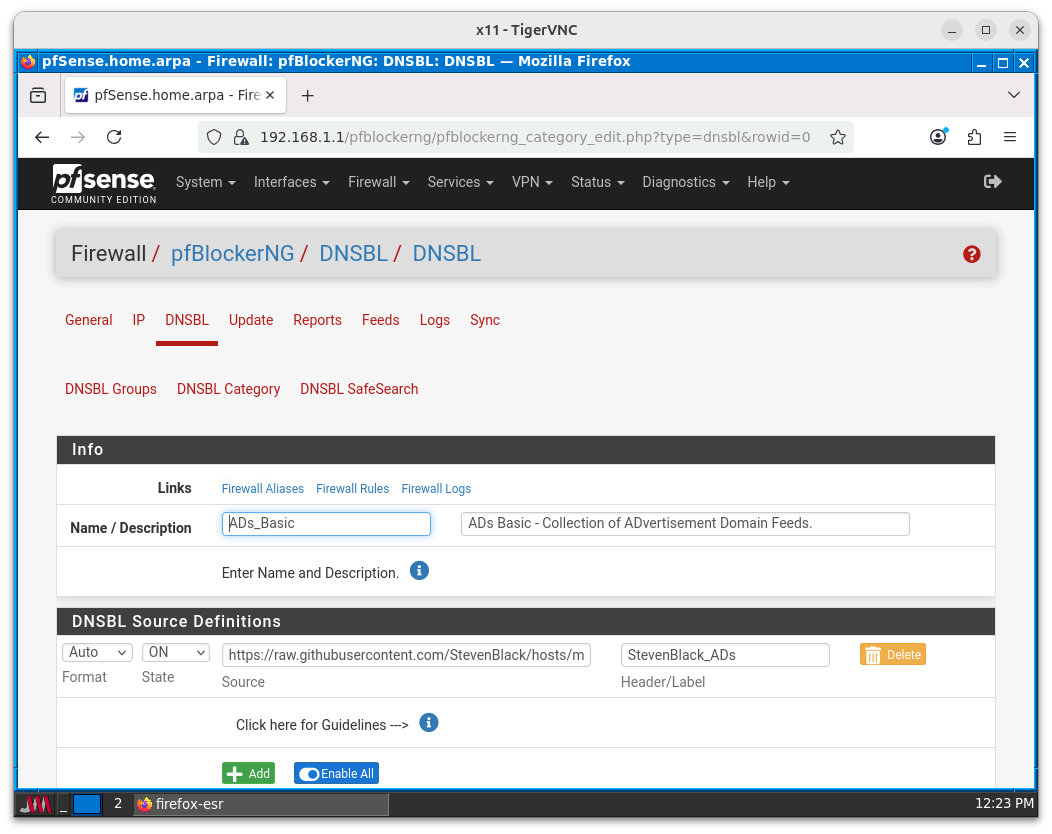

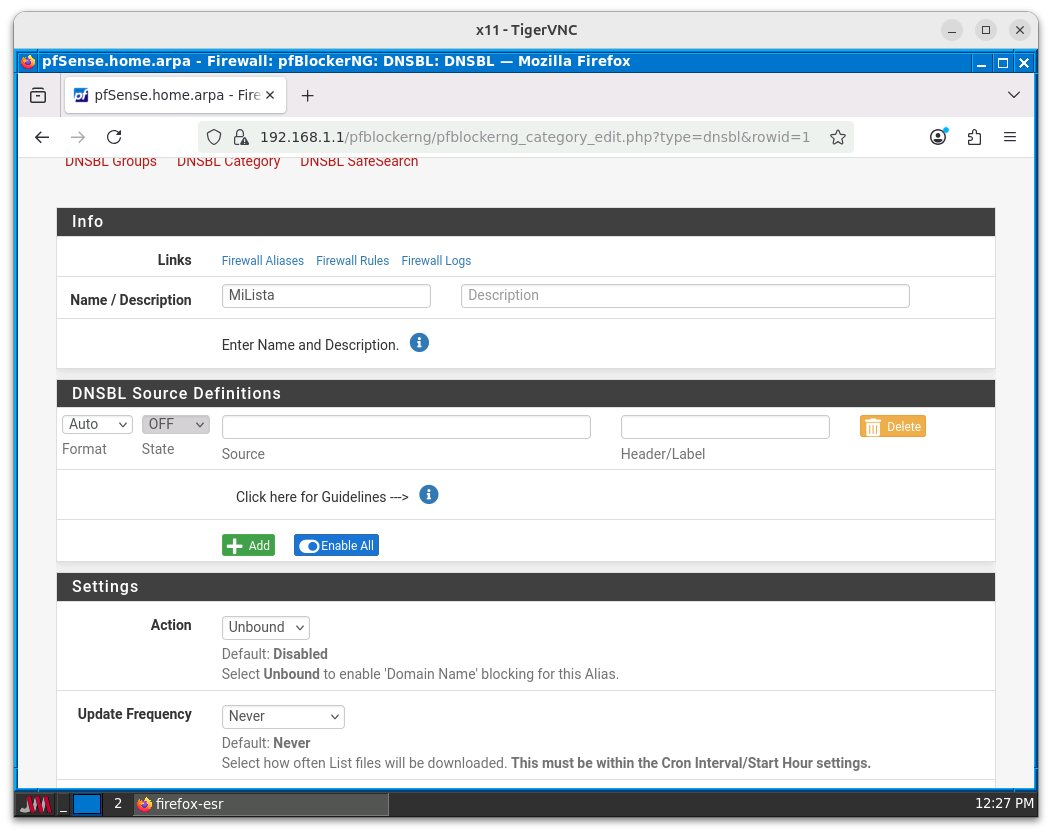

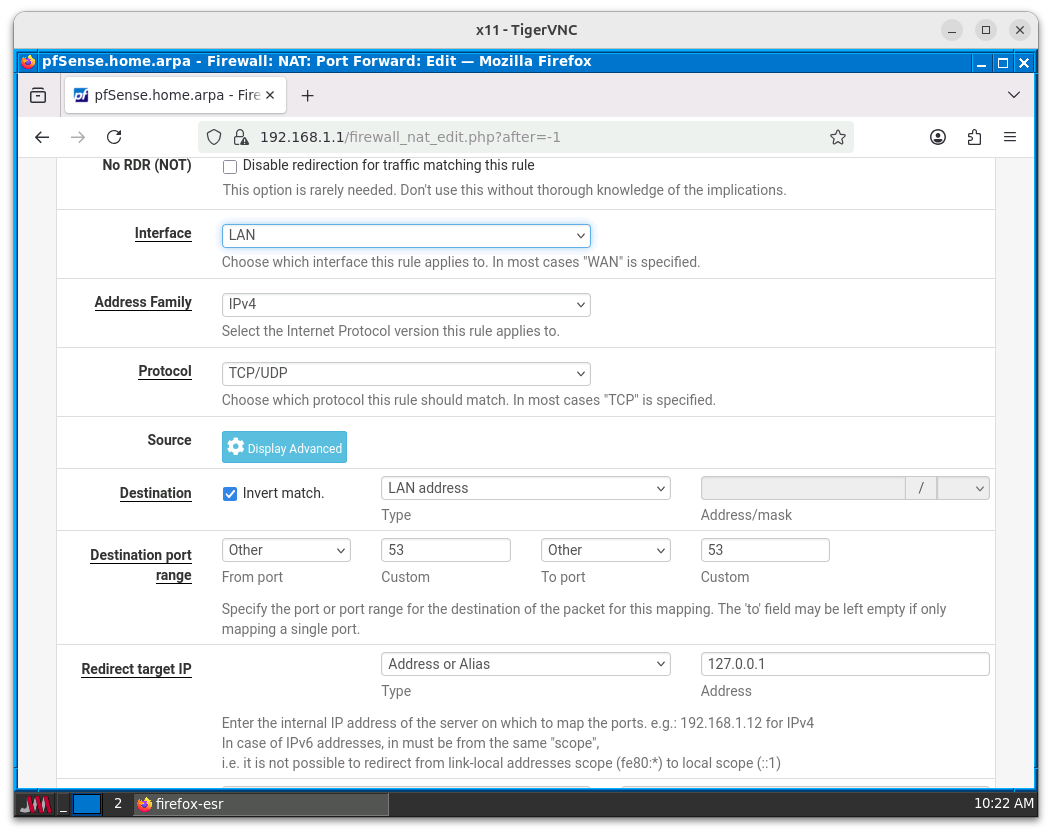

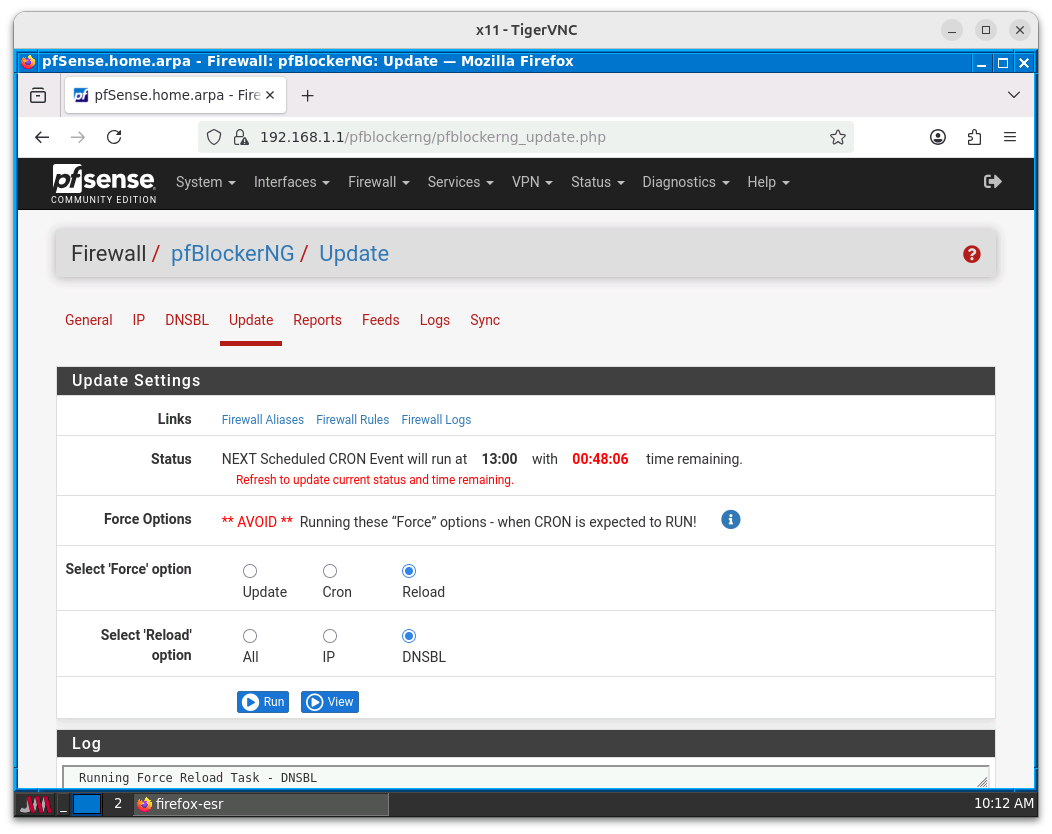

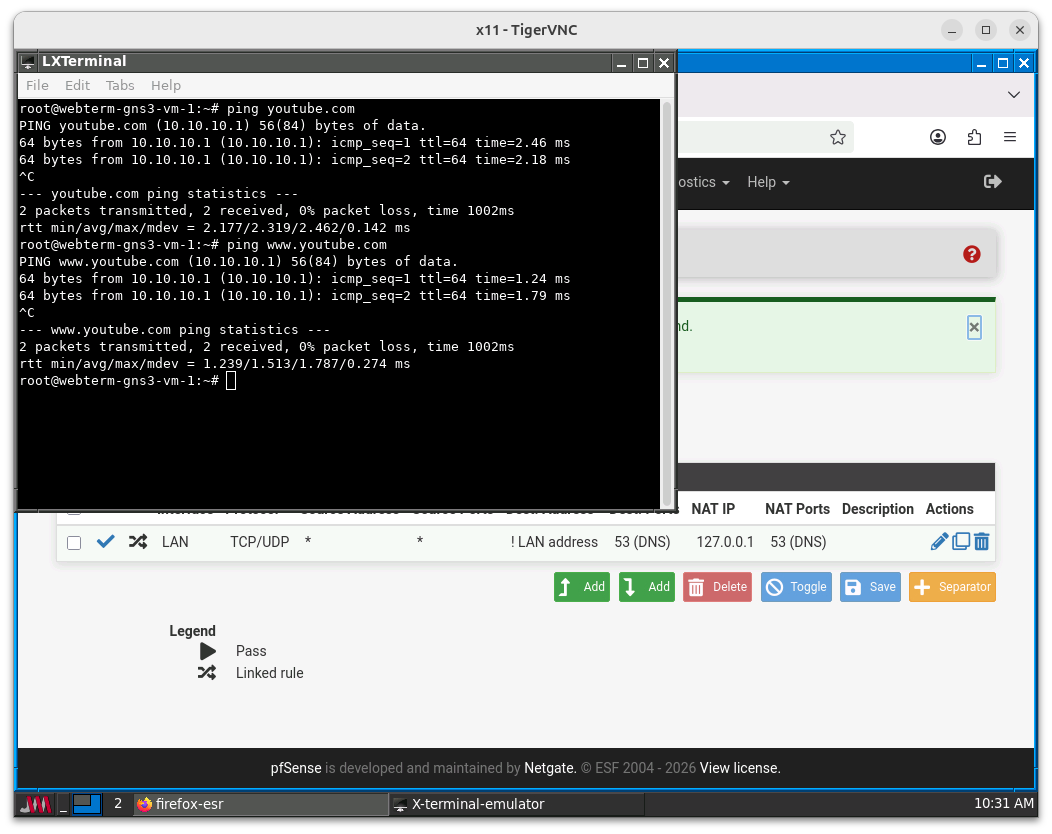

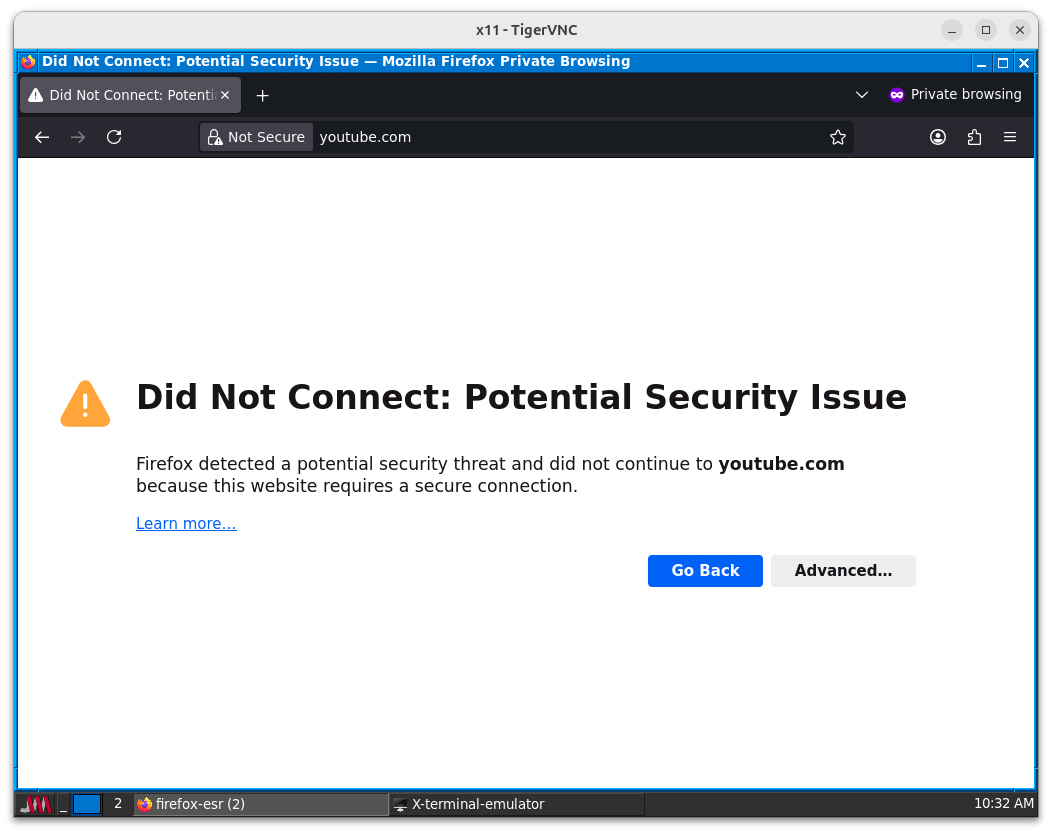

9.2 Práctica: Router-on-a-Stick con NAT y ACLs